引言:揭开百度蜘蛛的神秘面纱

在网站运营与搜索引擎优化(SEO)的领域里,百度蜘蛛抓取工具是一个至关重要的概念。它就像是百度搜索引擎派出的“数字巡检员”,不知疲倦地穿梭在互联网的每一个角落,对网页内容进行抓取、分析和索引。对于任何希望提升网站自然搜索流量的站长或内容创作者来说,理解百度蜘蛛的工作机制,并掌握优化其抓取效率的方法,是走向成功的必修课。本文将从多个维度深入探讨百度蜘蛛抓取工具,并提供一套行之有效的优化策略。

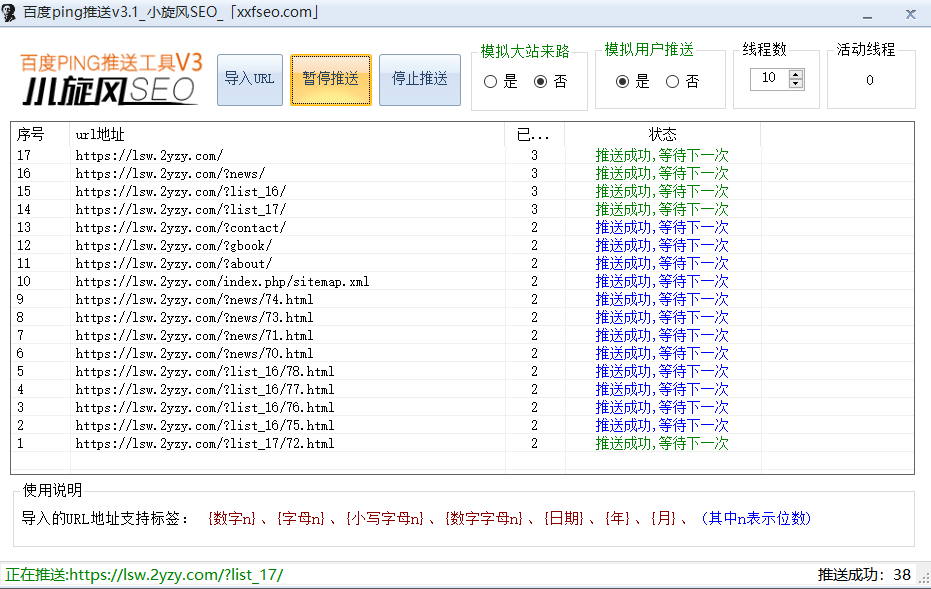

值得注意的是,很多站长喜欢使用各种工具来模拟蜘蛛抓取,例如

这类常用的站长辅助工具,可以帮助我们诊断和解决抓取过程中的问题。但最重要前提是我们必须清晰蜘蛛是如何工作的。百度蜘蛛抓取工具的工作原理与核心概念

百度蜘蛛,通常被称为“百度爬虫”(Baiduspider),其核心任务是通过链接发现新的或更新的网页,并将这些网页的内容下载到百度的服务器中。这个过程主要分为三个关键步骤:

- 发现与调度: 蜘蛛首先会从一个包含高质量链接的种子库出发,顺着链接“爬行”到新的页面。发现新链接的途径主要有两种:一是通过网站管理员主动提交的链接(如百度搜索资源平台的链接提交功能),二是通过跟踪现有页面上的外链和站内导航。

- 抓取与下载: 当蜘蛛到达一个网页后,会发送一个HTTP请求,将网页的HTML源代码、CSS样式表、JavaScript脚本以及图片等资源下载下来。

- 分析与存储: 下载完成后,百度会对网页内容进行深度分析,包括关键词提取、页面质量评估、链接质量判断等,最后将这些信息存入索引数据库。

对于广大站长来说,最重要的概念就是“抓取频率”与“抓取配额”。百度会根据网站的权重、更新频率、服务器响应速度等因素,动态分配给每个网站一个抓取配额。如果你的网站更新频繁、内容优质且服务器响应极快,百度会倾向于分配更高的抓取配额。

如何利用百度蜘蛛抓取工具进行自我诊断

了解百度蜘蛛抓取工具的关键在于“工具”二字。除了百度官方提供的“百度搜索资源平台”外,很多第三方工具也提供蜘蛛抓取模拟功能,例如我们前面提到的

。这些工具能够帮助我们完成以下工作:- 模拟抓取模拟: 通过工具模拟百度蜘蛛的抓取请求,我们可以看到页面返回的HTTP状态码(如200表示成功,404表示页面不存在,301表示重定向)、加载时间、页面内容大小以及是否包含影响抓取的元素(如robots.txt屏蔽、JavaScript动态加载内容无法抓取等)。

- 错误页面诊断: 定期使用蜘蛛抓取工具检查网站上的死链(404页面)、服务器500错误或抓取超时问题。大量的错误链接会严重消耗网站的抓取配额,导致搜索引擎忽略核心页面。

- 内链结构分析: 模拟蜘蛛的视角,检查网站的内链结构是否合理。如果重要的产品页或文章页离首页的点击距离过远(比如需要点击七八次才能到达),蜘蛛很可能不会深度抓取这些页面。

通过上述诊断,站长可以针对性地优化网站,确保百度蜘蛛能够顺畅、高效地访问到所有高质量内容。

提升百度蜘蛛抓取效率的四大优化策略

1. 优化服务器性能与响应速度

百度蜘蛛对于网站服务器的响应速度非常敏感。如果一个页面的加载时间超过3秒,或者频繁出现连接超时,蜘蛛可能会直接放弃抓取。因此,提升服务器性能是排名第一的优化策略:

- 选用高性能的云服务器,配置适量的带宽资源。

- 启用Gzip压缩,减少页面传输体积。

- 合理设置浏览器缓存与服务器端缓存,如使用Redis或Memcache。

- 避免在首页或核心页面中加载大量高分辨率、未压缩的图片。

- 确保30x重定向链正确且简短,不要出现回环重定向。

2. 科学地构建网站结构

清晰的网站结构不仅有助于用户浏览,更是引导蜘蛛高效抓取的“导航图”。建议遵循“扁平化”或“树形结构”原则:

- 首页链接到分类页,分类页链接到详情页,确保任何内容不超过三级链接深度。

- 使用面包屑导航(Breadcrumb),帮助蜘蛛理解页面在整个站点中的层级关系。

- 制作符合规范的XML Sitemap,并主动提交到百度搜索资源平台。Sitemap就是给蜘蛛提供的一张完整“地图”,里面列出了所有需要抓取的URL。

- 合理使用锚文本内链,不要使用“点击这里”之类的模糊描述,而是使用包含关键词的具体品牌名、产品名。

3. 管理robots.txt与屏蔽规则

robots.txt文件是告诉蜘蛛哪些页面可以抓取、哪些不可以的“协议”。很多网站由于配置不当,不小心禁止了蜘蛛抓取核心页面,造成严重损失。注意以下几点:

- 不要误屏蔽前端样式或JS文件。如果蜘蛛无法获取CSS/JS资源,它看到的页面可能是“空壳”,导致页面被视为低质量页面,甚至不被收录。

- 需要屏蔽的通常是后台管理页面(如/wp-admin/)、用户登录页面、购物车页面、只包含参数的不重要筛选页等。

- 利用robots.txt里的 Crawl-delay 参数给蜘蛛一个合理抓取间隔,防止过频抓取导致服务器压力过大。

4. 避免使用过多阻塞性JavaScript

百度蜘蛛虽然已经具有一定的解析JavaScript的能力,但对复杂异步JavaScript请求或SPA(单页应用)的兼容性仍不够完美。最佳实践是使用SEO友好的框架(如Nuxt.js或Next.js的SSR模式)来提供服务端渲染内容。如果不得不大量依赖JS,请确保关键内容通过HTML直接呈现,或使用代码调试工具(例如

这类站长常用模拟工具)测试蜘蛛能否看到完整内容。常见误区与高级技巧

许多新手站长在接触百度蜘蛛抓取工具时,容易陷入几个误区:

- 误区一:提交链接过多 = 被抓取更多。 真实的抓取频次主要受网站权重与服务器稳定性影响。无节制提交垃圾链接只会浪费配额。

- 误区二:用高频率刷新网站首页“定关键词”会被抓。 频繁微小改动但无实质内容更新,并不会收获更多抓取频次,只会让蜘蛛判定该页面不稳定。

- 误区三:完全模仿蜘蛛抓取工具的参数。 有些站长尝试通过修改User-Agent伪装成蜘蛛,以获取特殊权限或绕过风控。这是一种违反规则的行为,可能导致网站被惩罚。

真正的高阶技巧在于:将内容质量与数据指标结合起来,不断测试迭代。比如,通过

这类工具观察一个页面被抓取多少次后才会被收录;对照百度搜索资源平台的抓取异常报告,有针对性地修复死链或调整内链。耐心和细节是决定成败的关键。结语:站在蜘蛛的视角思考

百度蜘蛛抓取工具不仅仅是一个技术概念,它代表了搜索引擎算法与网站服务器之间高效协作的资源分配过程。对于每一个致力于长期发展的网站而言,从用户体验和搜索引擎友好度两个角度出发,去优化每一次抓取请求与内容交付,是获得持久流量的不二法门。

当你下一次看到服务器日志中爬虫轨迹,或打开模拟工具检查页面时,不妨问自己:这个页面提供了怎样的价值?它是否值得百度蜘蛛耗费一次珍贵的抓取配额去访问?如果答案是肯定的,那么恭喜你,你已经掌握了百度蜘蛛抓取工具背后的核心逻辑。不断学习、实践与优化,你的网站终将赢得搜索引擎的青睐。

暂无评论内容