在网站运营和搜索引擎优化(SEO)的日常工作中,百度蜘蛛抓取工具无疑是每位站长和内容创作者最熟悉,却又最常产生困惑的概念。它如同一位神秘的访客,悄无声息地来到你的网站,评估每一篇内容的价值。如果这位访客对你的站点“视而不见”,那么你的优质内容就如同藏在深巷中的美酒,无人问津。本文将深度解析百度蜘蛛的工作原理,并提供一套行之有效的优化策略,帮助你的网站从“蜘蛛不理”走向“蜘蛛常驻”。

一、百度蜘蛛抓取工具:网站与搜索引擎的“桥梁工程师”

百度蜘蛛抓取工具,并非一个单一的软件或按钮,而是百度搜索引擎基于海量服务器和复杂算法构建的一套自动化程序系统。其核心任务是从互联网上发现新的或更新的网页,并通过HTTP协议将网页内容下载到百度自己的服务器上。这个过程被称为“抓取”或“爬行”。

可以这样理解:因特网是一个巨大的图书馆,我们的网站就像一本本书。百度蜘蛛抓取工具就是图书馆的“图书管理员”,他需要定期巡架,发现新书(新网页),检查旧书是否有内容更新,然后将这些书的内容搬回总馆(百度数据库),以便读者(搜索用户)能够检索到。如果没有这位“图书管理员”,网站内容将永远无法出现在搜索结果中。

然而,这位“图书管理员”并非对每本书都一视同仁。它有自己的偏好、规则和访问限制。一个拥有良好链接结构的网站,就像一本目录清晰、装订牢固的书,蜘蛛能轻松抓取。相反,一个充斥着死链、内容杂乱、加载缓慢的网站,蜘蛛往往会被困扰,甚至直接放弃抓取。

二、影响百度蜘蛛抓取的核心因素:搜索引擎的“红绿信号灯”

要有效利用百度蜘蛛抓取工具,就必须理解哪些因素会被视为“绿灯”(鼓励抓取)和“红灯”(阻碍抓取)。

2.1 网站结构与内链布局

蜘蛛进入网站后,首先会寻找入口。通常,网站首页、栏目页、网站地图(Sitemap)等页面是主要入口。如果你的网站结构混乱,所有页面都孤立无援,没有内链相互连接,蜘蛛很快就会陷入“信息孤岛”。建议搭建扁平化的树状结构:首页链接到主要栏目页,栏目页链接到内容页,内容页之间通过相关推荐、标签等方式进行串联。一个精心设计的网站地图XML文件,更是直接向百度蜘蛛发出的“邀请函”,清晰地列出了你希望被抓取的所有页面。

2.2 服务器稳定性与响应速度

想象一下,当蜘蛛访问你的网站时,服务器响应缓慢,甚至返回“403禁止访问”或“500服务器错误”,这无异于大门紧闭。蜘蛛的耐心是有限的,如果在几秒钟内无法获取相应,它就会放弃。服务器稳定性是抓取的基础。使用CDN(内容分发网络)加速、优化图片大小、压缩CSS/JavaScript代码、选择可靠的服务器提供商,都是提升响应速度的有效手段。一个高速、稳定的服务器,是持续获得百度蜘蛛青睐的基石。

2.3 robots.txt协议的使用

robots.txt文件就像一个网站的“门卫”,告诉蜘蛛哪些区域可以进入,哪些区域禁止入内。但很多站长容易犯两个错误:第一,误将所有文件都禁止抓取,导致网站成了“不设防的禁区”;第二,使用了错误的语法或字符,导致蜘蛛无法正确理解指令。要确保仅对不需要收录的页面(如后台、用户中心、重复页面)进行屏蔽,并对所有核心栏目页和内容页开放。建议在robots.txt文件末尾添加Sitemap链接,方便蜘蛛直接访问。

2.4 内容质量与原创性

百度蜘蛛抓取的本质,是为了获取有价值的内容。一个充满抄袭、拼凑、低劣内容的网站,即使蜘蛛频繁访问,也会很快厌倦并降低抓取频率。反之,一篇高质量、有深度、完全原创的10万+字长文,或一个持续更新的专业专栏,会极大地吸引蜘蛛的注意力。内容是网站的灵魂,也是蜘蛛不请自来的根本原因。

三、实用工具与实战建议:让“蜘蛛”成为你的常客

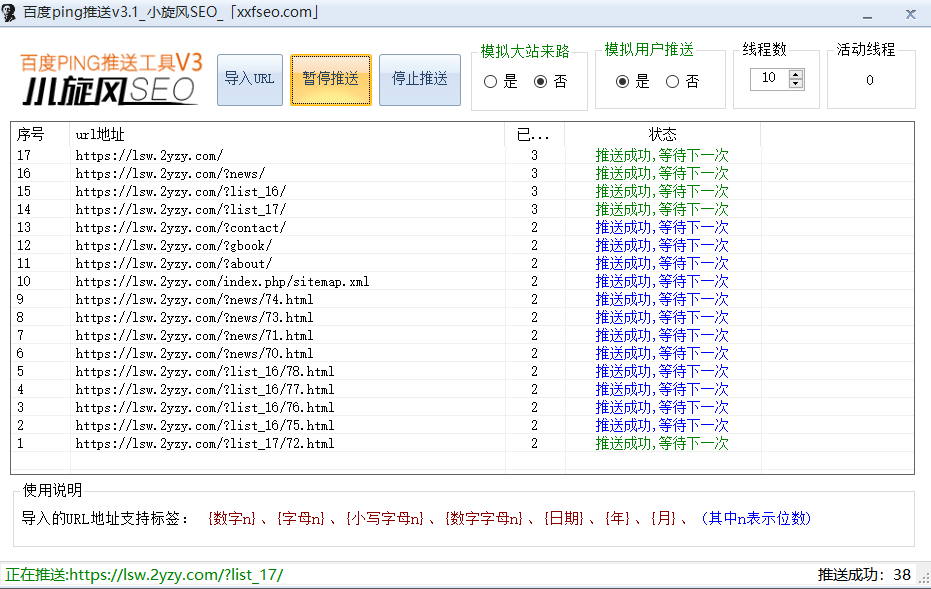

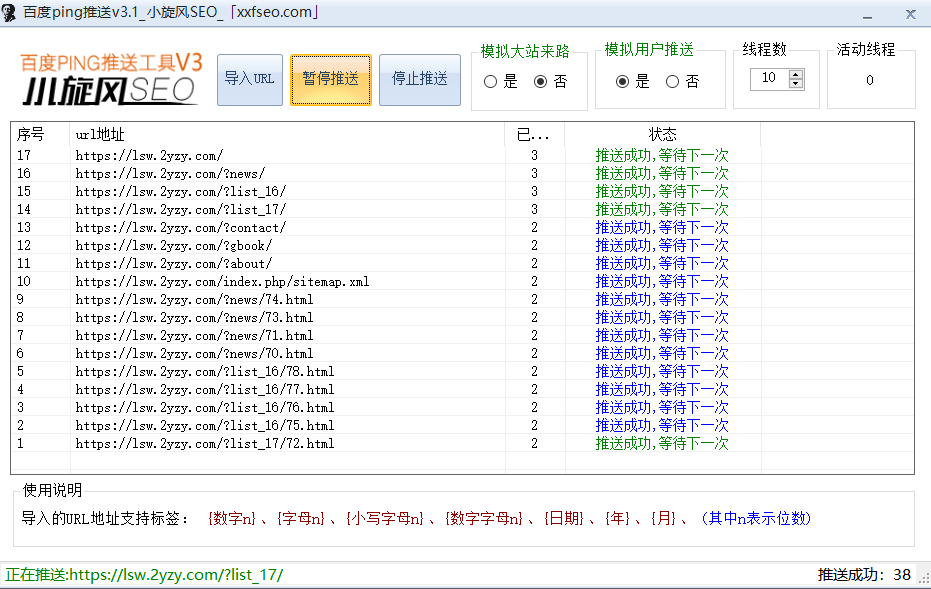

理解了原理和因素,我们还需要借助工具来评估和优化。市面上有许多百度蜘蛛抓取工具辅助分析的工具,例如百度官方的百度站长平台(Search Resource Platform),其中提供了抓取诊断、抓取异常、流量与关键词分析等功能。而作为一款备受关注的专业级SEO分析与监控工具,在百度蜘蛛抓取行为模拟、抓取频率分析、内链优化建议等方面有着独特的优势。使用这类工具,可以直观地看到以下信息:

- 蜘蛛来访日志:查看百度蜘蛛具体在什么时间、访问了哪些页面、停留了多久。

- 抓取失败页面:分析哪些页面因为服务器错误、链接失效或速度过慢而没有被成功抓取。

- 不抓取页面:识别那些从未被蜘蛛访问过的页面,并分析原因(如缺少链接、被robots禁止等)。

- 抓取优先级:通过工具模拟Spider,测试不同页面的URL是否容易被发现。

建议站长每周至少使用这些工具进行一次全面检查,发现异常及时处理。例如,如果发现某个新发布的优质页面连续一周未被抓取,应立即使用百度站长平台的“手动提交”功能,并检查该页面是否有来自首页或高权重页面的内链。

四、误区与避雷:常见的蜘蛛抓取“陷阱”

在追求百度蜘蛛抓取工具高效工作的过程中,部分站长容易走入误区:

误区一:盲目追求蜘蛛抓取频率。 很多站长认为蜘蛛来得越勤越好。然而,搜索引擎更看重内容的“质量”和“更新频率”。如果网站内容长期不更新,即使蜘蛛每天来一次,也只能看到一成不变的页面,这会降低蜘蛛对网站的整体评分。相反,如果网站每天都在更新高质量原创内容,即使蜘蛛一周只来一次,也足以保证新内容及时入库。

误区二:忽视404页面。 当蜘蛛访问一个已经删除或失效的页面时,正确的做法是返回404状态码,而不是302或200状态码。一些站长为了“不留空页面”,将所有404页面跳转到首页,这反而会误导蜘蛛,浪费抓取资源,并可能被搜索引擎视为“软404”,从而惩罚网站。

误区三:滥用外部链接交换。 虽然外部链接有助于蜘蛛发现你的网站,但大量低质量、不相关的垃圾链接,不仅不能提升权重,反而会让蜘蛛认为你在进行“作弊”,从而降低抓取频次甚至将网站加入黑名单。高质量的外部链接来自相关行业、有权威、有自然流量的网站。

误区四:使用封闭的JavaScript框架。 百度蜘蛛虽然现在对JavaScript的渲染能力有了大幅提升,但并非100%支持。如果你的整站内容全部通过JavaScript动态加载,而蜘蛛在抓取时无法读取到最终的HTML文本,那么你的内容在搜索引擎眼中可能是一片空白。建议保留服务端渲染(SSR)或预渲染方案,确保蜘蛛能直接读到内容。

五、结论:从“不让蜘蛛抓”到“蜘蛛主动来”

百度蜘蛛抓取工具是网站与世界对话的窗口,它的工作是否顺畅,直接决定了你的内容能否被用户发现。优化蜘蛛抓取,绝非一次性的任务,而是贯穿网站生命周期的持续工作。

总结一下,一个成功的抓取优化策略离不开以下几点:

- 结构为王: 建立清晰、符合逻辑的网站导航和内链结构。

- 速度为基: 确保服务器快速、稳定地响应蜘蛛请求。

- 内容为本: 持续产出高质量、原创、有价值的内容。

- 工具为伴: 善用百度站长平台和如这类专业工具进行诊断和监控。

- 避雷纠错: 避免上述提到的常见误区,特别是处理好404页面和JavaScript渲染问题。

当你从心底里把百度蜘蛛抓取工具当作自己网站的“合作伙伴”,而非一个需要应付的“考官”时,你就会发现,它不再是困扰你的难题,而是帮助你走向更广阔用户的桥梁。从今天开始,检查你的robots.txt,优化你的服务器速度,更新你的网站地图,然后可以像等待客人一样,期待百度蜘蛛的每一次到访。

只有蜘蛛抓取顺畅,你的内容才能被发现,你的价值才能被看见。在这个信息爆炸的时代,让百度蜘蛛抓取工具成为你最忠实的“搬运工”,将你的优质内容传递给每一个正在搜索的求知者。

暂无评论内容