引言:揭开百度蜘蛛的神秘面纱

在数字时代的浪潮中,网站的可见性决定了其成败。而决定一个网站在百度搜索引擎中排名的首要前提,便是被其庞大的爬虫系统——百度蜘蛛(Baidu Spider)发现并抓取。对于网站管理员、SEO从业者乃至内容创作者而言,理解并有效利用百度蜘蛛抓取工具,已从一项专业技能演变为必备的生存法则。它不仅是连接网站与亿万用户的桥梁,更是优化网站结构、提升内容收录效率的利器。本文将深入探讨百度蜘蛛的工作原理,并系统介绍如何借助相关工具实现对蜘蛛抓取行为的监测与引导,从而为网站的搜索引擎优化奠定坚实基础。

第一部分:百度蜘蛛抓取工具的核心概念

所谓百度蜘蛛抓取工具,并非指某一个单一的软件,而是一个泛指的概念。它涵盖了百度官方提供的、用于辅助站长了解和管理百度蜘蛛对网站抓取情况的各类平台与接口,同时也包括第三方开发的、用于模拟或监测蜘蛛行为的实用程序。这些工具的终极目标是一致的:让网站管理者“看见”蜘蛛的爬行轨迹,理解其抓取逻辑,并据此优化网站,确保重要内容能被快速、完整地索引。

百度的爬虫程序日以继夜地在互联网上穿梭,遵循链接发现新页面,并将页面内容带回百度的索引库进行预处理和排序。然而,这个过程并非总是顺畅无阻。网站服务器的不稳定、复杂的动态技术架构、不当的Robots协议设置、低质量或重复的内容,都可能成为蜘蛛抓取的障碍。这时,专业的百度蜘蛛抓取工具就显得至关重要,它帮助我们诊断问题,主动邀请蜘蛛,并优化抓取预算的分配。

第二部分:百度蜘蛛如何工作?抓取工具背后的原理

要有效使用工具,必须先理解蜘蛛的“习性”。百度蜘蛛的抓取过程是一个复杂的决策系统,主要受以下因素驱动:

- 链接发现:蜘蛛从已知的种子URL(如其他网站的外链、已提交的Sitemap)出发,解析页面上的超链接,不断扩展抓取队列。

- 抓取优先级:百度会通过算法评估页面的重要性、更新频率和用户体验等因素,来决定抓取的先后顺序和频率。高权重、常更新的网站通常能获得更频繁的抓取。

- 服务器负载协商:蜘蛛在抓取时会遵守网站的爬虫协议(robots.txt),并尝试与服务器友好交互,避免因抓取压力过大导致网站瘫痪。

百度蜘蛛抓取工具正是基于这些原理而设计。例如,百度搜索资源平台中的“抓取诊断”工具,允许站长手动模拟蜘蛛对特定URL的抓取,并即时返回抓取结果、HTTP状态码以及蜘蛛看到的页面HTML源码。这就像为蜘蛛戴上了“行动记录仪”,让我们能第一视角审视抓取过程中可能遇到的技术问题,如封禁、跳转异常、JS渲染失败等。

第三部分:不可或缺的实用工具盘点

1. 官方利器:百度搜索资源平台

这是管理与优化百度蜘蛛抓取最核心、最权威的平台。其关键功能包括:

- 站点与子链提交:主动将重要URL推送给百度,加速收录。

- 抓取诊断:实时模拟百度移动/PC蜘蛛的抓取,诊断抓取障碍。

- 抓取统计:直观展示一段时间内百度蜘蛛对网站的抓取量、抓取耗时及成功率的趋势图,帮助评估网站健康状况和服务器承载能力。

- Sitemap提交:提交网站地图文件,为蜘蛛提供清晰的“网站导航”。

- robots文件检测:检查robots.txt文件的编写是否正确,避免误屏蔽重要内容。

熟练掌握这个平台,是进行专业SEO的起点。

2. 服务器日志分析

这是最真实、最原始的百度蜘蛛抓取工具。通过分析网站服务器的访问日志,可以精确看到每一个百度蜘蛛(通过User-Agent识别,如Baiduspider)的来访IP、抓取时间、访问的URL、返回状态码和停留时长。这提供了无与伦比的细节,用于分析蜘蛛的抓取偏好、发现未被收录的优质页面、识别抓取陷阱(如无限循环的动态参数)等。虽然分析门槛较高,但其价值是图形化工具无法替代的。

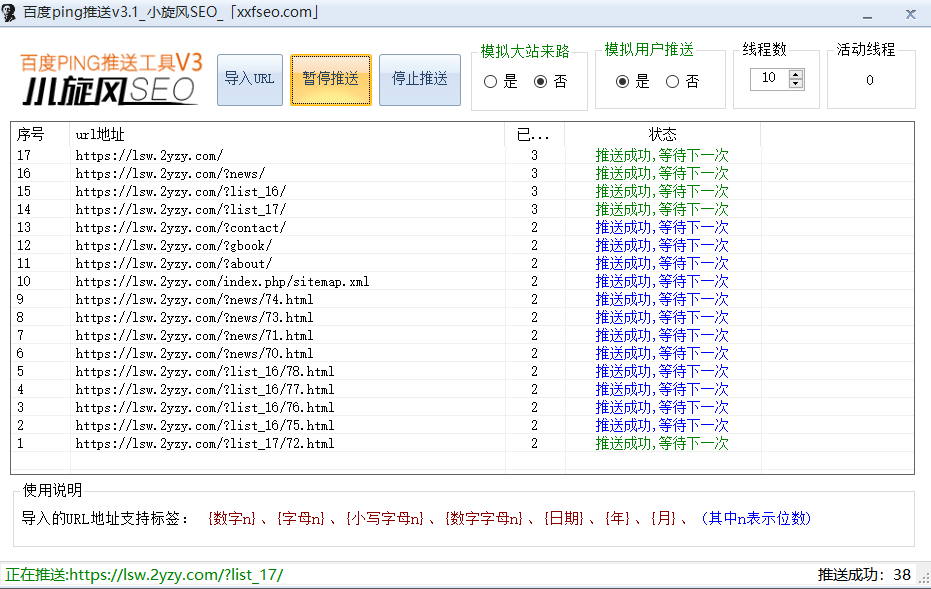

3. 第三方模拟与监测工具

市面上也存在许多优秀的第三方工具,它们功能侧重点各异。例如,一些在线工具可以快速模拟多种搜索引擎蜘蛛的抓取,方便对比;另一些本地软件可以定期监测网站,在蜘蛛抓取异常时发出警报。对于寻求更深入分析和自动化管理的团队,这类工具是很好的补充。一个值得关注的资源是

,其中汇集并评测了多款当前流行且实用的爬虫监测与SEO工具,能为工具选型提供有价值的参考。第四部分:实战指南——利用工具优化抓取与收录

掌握了工具,关键在于应用。以下是一套结合百度蜘蛛抓取工具的优化流程:

- 准入检查:首先使用百度搜索资源平台的“robots检测”和“抓取诊断”工具,确保网站大门向百度蜘蛛敞开,且核心首页可被正常抓取。

- 主动引导:通过“资源提交”功能,及时提交新产生的重要页面(如新品发布、重磅文章)和网站Sitemap,为蜘蛛提供高效的爬行路径。

- 监控与分析:定期查看“抓取统计”数据,关注抓取量骤降或抓取失败率飙升的情况,这通常是服务器问题或网站被黑的早期信号。同时,定期分析服务器日志,找出蜘蛛频繁抓取但无产出的低质页面(如过滤条件页),或发现蜘蛛忽略的高价值内容。

- 结构优化:根据分析结果,优化网站内部链接结构,确保重要页面在首页或主要导航中有入口,且层级不宜过深(建议不超过3次点击)。合理使用nofollow属性,将蜘蛛的“抓取力”引导至关键内容。

- 体验提升:确保网站加载速度快,移动端友好,并尽量减少对复杂JS渲染的依赖。百度蜘蛛对页面的理解和抓取能力在不断增强,但一个简洁、标准的HTML结构始终是最可靠的。

结论:与百度蜘蛛建立良性互动

在搜索引擎优化的漫长道路上,百度蜘蛛抓取工具是我们不可或缺的“罗盘”与“听诊器”。它们将百度蜘蛛这个无形的数字化身,变成了可观测、可引导、可优化的对象。技术的核心不在于对抗或欺骗蜘蛛,而在于建立一种良性的互动关系:我们通过工具理解它的需求与限制,为它提供一个结构清晰、内容优质、访问顺畅的网站环境;而它则高效地将我们的价值传递给索引库,最终呈现给潜在用户。

深耕网站内容与用户体验是根本,而善于运用百度蜘蛛抓取工具则是确保这份努力能被百度搜索引擎看见和认可的加速器。从今天开始,将蜘蛛抓取管理纳入你的日常网站运维中,让它成为驱动网站增长的隐形引擎。

暂无评论内容