引言:当搜索引擎的“触角”探向你的网站

在浩瀚无垠的互联网信息海洋中,每天都有数以亿计的网页诞生、更新与沉寂。对于网站运营者和内容创作者而言,最大的渴望莫过于让自己的精心之作被搜索引擎发现、收录,并呈现在亿万用户的搜索结果中。然而,你是否思考过,搜索引擎是如何“看见”并理解你那成千上万个页面内容的?这背后至关重要的“侦察兵”,便是我们常说的网络爬虫,而对于中文互联网世界,百度蜘蛛抓取工具无疑是其中最核心的角色之一。理解它的工作原理,善用其逻辑,是网站能否在搜索引擎中获得良好表现的基石。本文将深入浅出地为你揭开百度蜘蛛的神秘面纱,并探讨如何优化网站以更好地与之“对话”。

第一章:初识“侦察兵”——什么是百度蜘蛛?

百度蜘蛛,官方名称为“百度爬虫”(Baiduspider),是百度搜索引擎自动运行的一个程序。它的核心任务如同其名,像一个不知疲倦的蜘蛛,在网络这张巨大的“网”上不断爬行,其主要目标就是抓取和收集网页信息。

你可以将它理解为搜索引擎的“信息采集员”。它从一个已知的网页链接(种子URL)出发,下载该页面的HTML代码,提取其中的文字、链接等信息,然后将新发现的链接加入待抓取队列,再前往下一个页面,如此循环往复。百度会将抓取到的页面内容存入其庞大的数据库(即索引库),经过复杂的分析和处理后,才能为用户提供精准的搜索结果。

因此,网站若想被百度收录,第一步就必须被百度蜘蛛成功抓取。没有抓取,就谈不上收录和排名。这就像一家新开的店铺,如果连地图测绘员都没来过,又怎么可能在地图上被标记出来呢?

这篇文章曾深入剖析过蜘蛛抓取的基本逻辑,是理解后续优化策略的基础。第二章:洞察“侦察路径”——百度蜘蛛如何工作?

了解蜘蛛的工作模式,有助于我们为其提供更友好的访问环境。其抓取过程并非无序,而是遵循着一套复杂的优先级和策略。

- 抓取频率与深度:百度蜘蛛会根据网站的权重、更新频率、历史抓取表现以及服务器压力等因素,动态调整对网站的访问频率和抓取深度(即沿着链接能爬取多少层级)。一个高权重、内容更新频繁且结构清晰的网站,蜘蛛会更频繁、更深入地访问。

- 遵循Robots协议:Robots.txt是网站根目录下的一个文本文件,它是网站与爬虫之间的“君子协议”。通过它,站长可以指令蜘蛛哪些目录或文件可以抓取,哪些禁止抓取。正确配置Robots协议,是引导蜘蛛、保护隐私内容的关键一步。

- 解析页面与跟踪链接:蜘蛛抓取页面后,会解析HTML代码,提取纯文本内容(这是它“理解”页面主题的核心)以及页面上的所有超链接(包括站内链接和站外链接)。这些链接构成了它下一步爬行的路径图。

- 处理动态内容与障碍:现代网站大量使用JavaScript、Ajax等技术动态加载内容。传统的蜘蛛对此类内容的抓取能力有限,但随着技术进步,百度蜘蛛也在不断进化以更好地渲染和抓取动态内容。然而,过于复杂的交互或加载过慢的页面,仍可能成为蜘蛛抓取的障碍。

第三章:优化“侦察环境”——如何让百度蜘蛛更高效地抓取?

既然蜘蛛的抓取是收录的前提,那么优化网站的“可抓取性”就成为SEO工作的重中之重。以下是一些核心的优化策略:

- 打造清晰稳定的网站结构:扁平化、逻辑清晰的网站结构,如同为蜘蛛铺设了平整的“高速公路”。通过合理的导航、面包屑路径和内部链接(如相关文章推荐),确保蜘蛛能从首页在3-4次点击内抵达网站的任何重要页面,并能顺畅返回。

- 保证服务器稳定与访问速度:网站的服务器稳定性直接影响蜘蛛的访问体验。频繁的宕机或过慢的响应速度(建议页面加载时间控制在3秒内),会导致蜘蛛抓取失败或减少抓取频次。选择可靠的托管服务商并优化页面加载速度是基础保障。

- 生成并提交网站地图(Sitemap):网站地图(XML格式)是一个专门为搜索引擎准备的、包含网站上所有重要页面链接的文件。主动通过百度搜索资源平台(原站长平台)提交Sitemap,相当于为蜘蛛提供了一份精准的“网站全貌地图”,能有效提高重要页面的发现和抓取效率。

- 精心设置Robots.txt与Meta Robots标签:合理使用Robots.txt引导蜘蛛避开无意义的页面(如后台登录页、打印页等),节省其抓取配额。同时,对于特定页面,可以在HTML头部的<meta name=”robots”>标签中,更精细地控制索引和跟踪行为(如noindex, nofollow)。

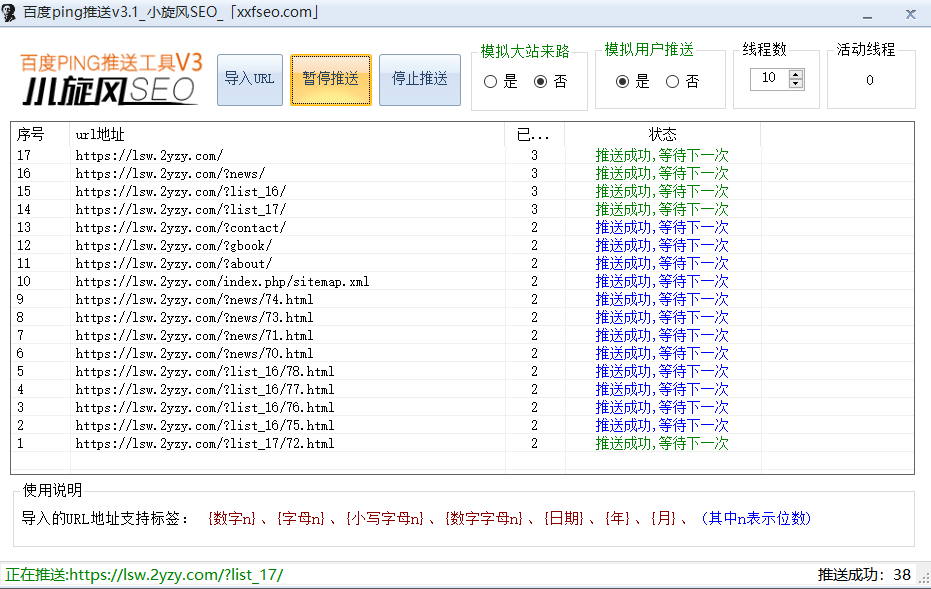

- 创建优质内容与合理的内外链:持续产出原创、有价值的内容是吸引蜘蛛频繁光顾的根本动力。同时,百度蜘蛛抓取工具通过跟踪链接发现新页面,因此,构建合理的站内链接网络,并获取高质量网站的自然外链,能为蜘蛛提供更多、更优质的入口路径。

第四章:借助“侦察报告”——利用工具监控蜘蛛抓取状态

优化不能盲目进行,必须依赖数据。百度搜索资源平台提供了强大的工具,让站长能够直观地监控蜘蛛在自己网站上的活动,这可以说是最高效的百度蜘蛛抓取工具分析平台。

- 抓取频次:可以查看百度蜘蛛对网站的日抓取量,并可以手动提交建议,申请提升或降低抓取频率,以匹配服务器承载能力。

- 抓取诊断:这是极其实用的功能。可以模拟百度蜘蛛抓取指定URL,并查看抓取结果(返回的HTTP状态码、抓取到的页面HTML代码),快速诊断页面是否存在抓取障碍(如404、503错误,或被Robots拦截等)。

- 抓取异常:平台会汇总报告蜘蛛在抓取过程中遇到的各类问题,如死链、超时、DNS错误等,帮助站长系统性排查网站技术问题。

- 索引量:虽然不是直接抓取数据,但索引量(网站被百度收录的页面总数)的变化趋势,是抓取效果最直接的体现。抓取是过程,索引是结果。

定期查看这些报告,就如同审阅“侦察兵”发回的情报,能让我们及时发现问题,调整优化策略。

结语:与蜘蛛和谐共处,构筑长久搜索价值

百度蜘蛛抓取工具并非一个具象的、可供下载的软件,而是搜索引擎庞大算法体系中负责前端数据采集的核心机制。它的工作,是连接网站与搜索引擎索引库的桥梁。对于网站管理者而言,深入理解并主动优化蜘蛛的抓取体验,是一项长期而基础的工作。

其核心思想并非“欺骗”或“操控”蜘蛛,而是为其创造一个稳定、快速、结构清晰、内容优质的访问环境,确保网站最有价值的部分能够被顺畅、高效地发现和抓取。这是一切后续搜索引擎优化工作的起点。当你开始以蜘蛛的视角审视自己的网站时,你便迈出了从被动等待收录到主动拥抱搜索引擎的关键一步。记住,善待这位不知疲倦的“侦察兵”,它终将把你的网站价值,精准地传递到亿万用户的搜索结果之中。

暂无评论内容