引言:看不见的访客,决定你的网站命运

在浩瀚的互联网海洋中,你的网站如同一座孤岛。如何才能让远方的旅人(用户)发现并登上这座岛屿?答案的关键,往往掌握在一位特殊的“侦察兵”手中——它就是百度蜘蛛。对于每一位网站运营者、SEO专员乃至内容创作者而言,理解并有效利用百度蜘蛛抓取工具,就如同掌握了与搜索引擎直接对话的密钥。这不再是可有可无的边缘知识,而是决定网站在搜索引擎结果页(SERP)中能见度的核心技能。本文将带你深入探究百度蜘蛛抓取工具的奥秘,从原理剖析到实战应用,为你提供一份完整的操作指南。

一、百度蜘蛛:搜索引擎的“眼睛”与“触手”

在深入工具之前,我们首先要理解工具所服务的对象。百度蜘蛛(Baidu Spider),又称百度爬虫或百度机器人,是百度搜索引擎自动程序的通俗名称。它的使命简单而艰巨:日夜不息地在互联网上爬行,访问并抓取海量网页内容,将其带回百度的索引库进行分析和存储。

为何抓取如此重要?道理很简单:如果一个网页从未被百度蜘蛛抓取过,那么它基本上就等于在百度搜索引擎中“不存在”。无论你的内容多么精彩,设计多么精良,都无法通过百度搜索被用户找到。因此,确保网站能够被蜘蛛顺利、高效、全面地抓取,是SEO(搜索引擎优化)一切工作的起点和基础。

然而,蜘蛛的爬行并非毫无规律。它会受到网站结构、robots协议、页面加载速度、服务器稳定性等诸多因素影响。很多时候,网站管理者自以为完美的页面,在蜘蛛眼中却可能布满荆棘,导致抓取失败或内容遗漏。这时,我们就需要借助专业的工具来洞察和解决问题。

二、百度蜘蛛抓取工具:你的专属“蜘蛛视角”模拟器

所谓百度蜘蛛抓取工具,广义上指的是能够模拟百度蜘蛛行为,帮助站长诊断抓取问题的各类平台和软件。其中最官方、最核心的,当属“百度搜索资源平台”(原百度站长平台)提供的系列工具。通过它们,你可以站在百度蜘蛛的立场上审视自己的网站,化被动等待为主动管理。

核心工具盘点:

- 抓取诊断工具:这是最直接的工具。你可以输入任一网站URL,选择“百度蜘蛛”作为模拟对象,发起一次抓取请求。工具会返回蜘蛛此次抓取的“所见所得”,包括HTTP状态码、抓取时间、返回的页面HTML代码等。这能让你立刻确认某个页面是否能被正常抓取,以及被抓取到的内容是否与你期望的一致(比如,是否存在因JS加载问题导致的主体内容缺失)。

- Robots工具:用于在线检测和生成robots.txt文件。robots.txt是网站与所有爬虫(包括善意和恶意的)的“交通规则”。通过此工具,你可以验证你的robots规则是否意外屏蔽了百度蜘蛛,或者其语法是否正确。

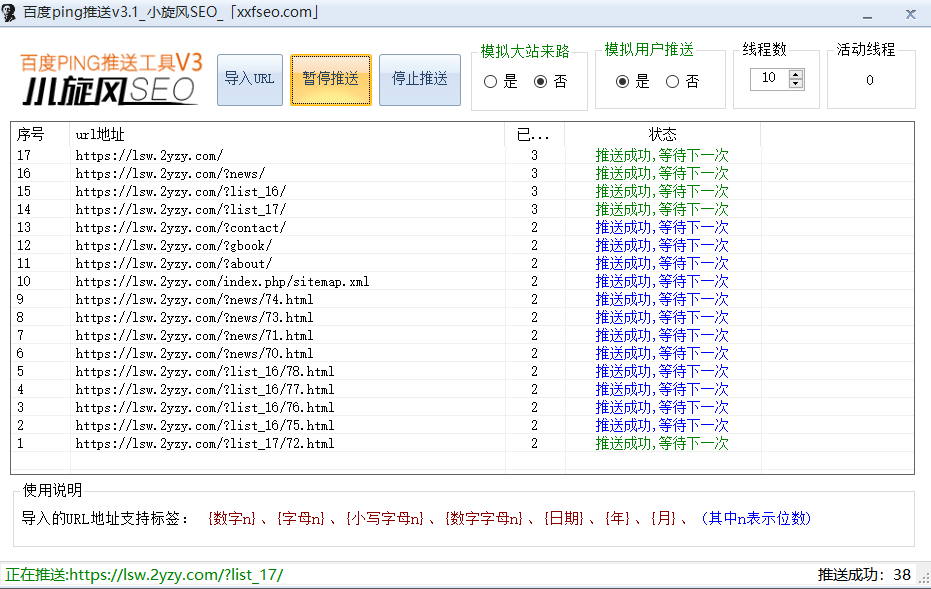

- 链接提交工具:包括主动推送、手动提交和sitemap提交。当你有新页面产生或重要页面更新时,可以通过这些工具主动向百度索引库“递上名片”,大大缩短蜘蛛发现和抓取页面的周期,尤其对于新站或深层页面至关重要。

- 网站体检工具:提供包括死链、安全检测、移动适配等在内的综合性检查,其中许多问题都会直接影响蜘蛛的抓取效率和用户体验。

当然,除了官方平台,市面上也有一些第三方开发的抓取分析工具或爬虫软件,它们可能提供更深入的爬行路径分析、批量检测等功能。例如,在一些专业的SEO资源站,你可以找到如这样的深度评测文章,对比不同工具的优势与适用场景,帮助您根据自身技术水平和需求做出选择。

三、实战演练:利用抓取工具诊断与优化网站

理解了工具是什么,下一步就是学以致用。让我们通过几个典型场景,来看看百度蜘蛛抓取工具如何在实际工作中大显身手。

场景一:新内容迟迟不被收录

问题:精心撰写的文章发布一周后,在百度中仍搜索不到。

诊断步骤:

- 使用“抓取诊断”工具,输入该文章页面的URL进行模拟抓取。

- 查看返回状态码。如果是404或500,说明页面本身访问有问题;如果是200,则进行下一步。

- 仔细对比“抓取到的HTML”与你浏览器中“查看网页源代码”的内容。重点检查文章正文部分是否在抓取结果中。如果缺失,可能是由于内容通过AJAX/JS动态加载,蜘蛛无法识别。

- 检查Robots工具,确认该页面所在目录未被屏蔽。

解决方案:若抓取正常但未收录,立即通过“链接提交”工具中的“主动推送”或“手动提交”功能,向百度推送该URL。若发现是JS渲染问题,则需要考虑实施服务器端渲染(SSR)或使用百度推荐的“异步加载规范”。

场景二:网站改版后流量暴跌

问题:网站进行URL结构改版后,来自百度的搜索流量显著下降。

诊断步骤:

- 利用抓取诊断工具,测试几个重要的旧版URL(301重定向指向新URL)。观察蜘蛛是否能顺利跟随重定向,并抓取到新页面内容。

- 使用“网站体检”工具中的死链检测功能,全面扫描是否在改版过程中产生了大量404错误页面。

- 在“抓取频次”工具中,观察近期百度蜘蛛对网站的访问频率是否有异常波动。频率骤降可能意味着蜘蛛在爬行中遇到了严重障碍(如大量死链、服务器频繁超时)。

解决方案:确保所有旧URL都有正确的301永久重定向。通过死链工具提交失效链接,帮助百度清理索引库中的旧数据。在搜索资源平台提交改版规则和新版sitemap,引导蜘蛛快速适应新结构。

场景三:怀疑网站存在隐藏的抓取障碍

问题:网站整体表现尚可,但总感觉收录不够充分,有些页面像被“遗忘”了。

诊断步骤:

- 分析网站日志:这是最高阶但也是最有效的方法。从服务器日志中过滤出百度蜘蛛(User-Agent包含Baiduspider)的访问记录,可以清晰看到它爬行了哪些URL、停留了多久、返回了什么状态码。你会发现蜘蛛实际关注的重点与你的想象可能大相径庭。

- 结合日志分析,使用抓取工具针对性测试那些访问量少但你认为重要的“冷门”页面或深层目录入口,检查是否存在技术壁垒。

- 审视网站导航和内部链接结构,确保所有重要页面都能通过不超过3-4次的点击从首页到达,因为蜘蛛的爬行深度是有限的。

四、超越抓取:工具背后的SEO哲学

熟练使用百度蜘蛛抓取工具,绝不仅仅是为了解决技术故障。它更是一种思维方式的训练,引导我们建立“蜘蛛友好型”的网站建设理念:

- 可访问性是基石:确保网站服务器稳定、打开速度快、不存在爬虫无法解析的技术(如过于复杂的JavaScript、Flash内容)。

- 内容为王,但结构是后:清晰扁平的网站结构、规范的URL、丰富的内部链接,就像为蜘蛛铺设了四通八达的高速公路,能让它高效抓取所有有价值的内容。

- 主动沟通胜过被动等待:积极利用搜索资源平台的各项工具,主动提交数据、反馈问题、查看消息,与搜索引擎建立良好的互动关系。

SEO是一场持久战,而抓取是这场战争的第一场战役。赢得了抓取,你的内容才拥有了登上舞台的入场券。

结论:让工具成为你的SEO增长引擎

在信息愈发饱和的今天,酒香也怕巷子深。百度蜘蛛抓取工具系列,正是为你照亮“巷子”、铺设通途的关键装备。它揭开了搜索引擎爬行过程的神秘面纱,将不可控的等待转化为可分析、可优化、可管理的科学流程。

从今天起,请将定期使用抓取诊断、关注搜索资源平台数据作为你的日常习惯。不要等到流量下滑时才慌忙检查,而应主动、持续地监控网站的健康状况。记住,对蜘蛛友好,本质上就是对用户友好。一个能被蜘蛛顺畅抓取、快速加载、清晰理解的网站,也必将为真实用户带来更佳的浏览体验,从而形成“技术优化-收录提升-用户体验好-排名巩固”的良性循环。

工欲善其事,必先利其器。现在,工具已在你手中,是时候深入你的网站后台,开启一场高效的抓取诊断与优化之旅了。搜索引擎的广阔流量,正等待着那些被妥善抓取和索引的优秀内容去赢取。

暂无评论内容