在当今竞争激烈的数字营销环境中,网站的搜索引擎可见性是成功的关键。对于广大中文网站管理员和SEO从业者而言,理解并优化百度搜索引擎的收录机制,是获取精准流量的核心环节。而这一切,都离不开一个关键角色——百度蜘蛛。本文将深入探讨专为分析百度蜘蛛行为而设计的百度蜘蛛抓取工具,解析其功能、应用场景以及如何有效利用它来大幅提升网站的SEO表现。

引言:百度蜘蛛——网站内容的“引路人”

百度蜘蛛,或称百度爬虫,是百度搜索引擎自动程序的总称。它如同一位不知疲倦的探索者,日夜不停地在互联网的海洋中穿梭,发现、抓取并分析网页内容,为其建立索引,最终决定其在搜索结果中的排名。一个网站如果无法被百度蜘蛛高效、准确地抓取,那么无论其内容多么优质,设计多么精美,都很难在百度搜索中获得理想的曝光。因此,监控和优化百度蜘蛛的抓取行为,便成为网站SEO工作的重中之重。专业的百度蜘蛛抓取工具,正是为此而生的强大助手。

一、什么是百度蜘蛛抓取工具?

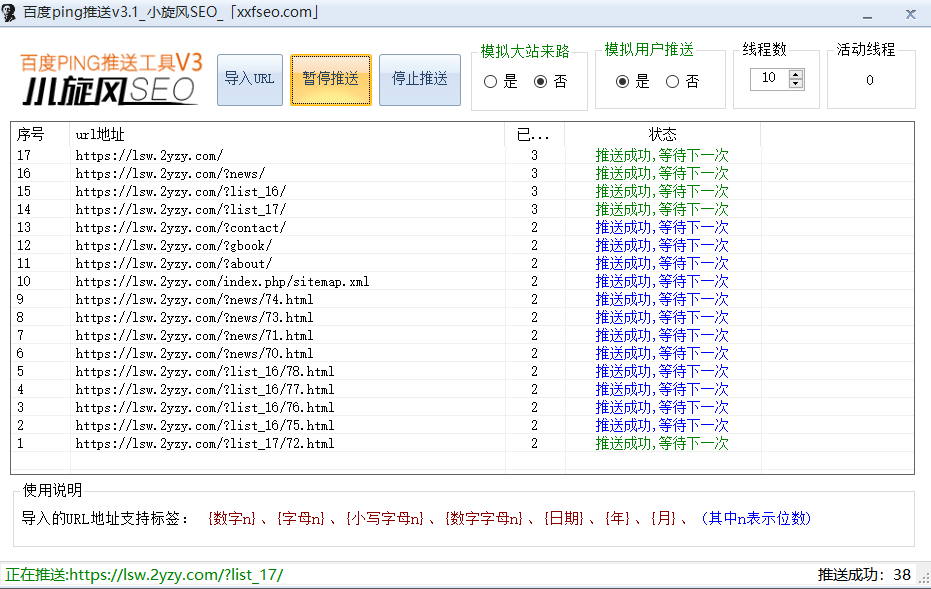

简而言之,百度蜘蛛抓取工具是一类专门用于模拟、检测、分析百度爬虫对网站访问情况的软件或在线服务。它并非百度官方发布的某个单一软件,而是涵盖了从简单日志分析到复杂云平台的一整套解决方案。这类工具的核心目标是让网站管理者能够“看见”蜘蛛的行为,从而发现问题、优化结构。

常见的工具类型包括:服务器日志分析工具(可直接从日志文件中筛选出百度蜘蛛的访问记录)、在线模拟抓取平台、以及集成了多种诊断功能的SEO综合平台。例如,在知名的SEO资源站

上,用户可以找到关于多种此类工具的详细评测和使用教程,帮助选择最适合自己需求的那一款。二、核心功能与应用价值

一个功能完善的百度蜘蛛抓取工具,通常能提供以下几项核心功能,每项都直接关系到网站的SEO健康度:

- 1. 蜘蛛模拟抓取: 工具可以完美模拟百度蜘蛛的User-Agent和请求方式,对指定URL进行抓取。这能让你以蜘蛛的“视角”查看页面,检查蜘蛛实际看到的内容是否与用户看到的(特别是与通过JavaScript动态加载的内容)一致。对于大量使用前端框架的现代网站,这一功能至关重要。

- 2. 抓取诊断与错误分析: 工具会详细报告在抓取过程中遇到的HTTP状态码(如404未找到、500服务器错误、301/302重定向链等)、下载时间、页面大小等信息。及时发现并修复这些错误,能防止爬虫浪费抓取配额,并确保重要页面被顺利索引。

- 3. 网站结构可视化与抓取路径分析: 通过爬行网站内部链接,工具可以生成网站结构地图,直观展示各个页面之间的链接关系。这有助于分析蜘蛛的抓取路径,发现可能存在的“孤岛页面”(缺乏内链支持的页面)或过于深层的目录结构,从而优化内部链接布局。

- 4. 元数据与关键词分析: 检查页面标题(Title)、描述(Description)、H标签等关键元数据是否被正确设置和抓取。同时,分析页面内容中的关键词密度和分布,为内容优化提供数据支持。

- 5. Robots.txt 与 Sitemap 校验: 验证网站的robots.txt文件是否错误地屏蔽了重要页面,或检查XML站点地图(Sitemap)的格式是否正确、提交是否有效,确保为蜘蛛提供清晰的“抓取指南”。

通过综合运用以上功能,网站管理者可以系统性地诊断网站的抓取可访问性、索引覆盖度,并针对性地进行优化。

三、如何利用工具进行实战优化?

掌握了工具的功能,接下来便是实战应用。以下是一个基于百度蜘蛛抓取工具的典型优化工作流:

- 第一步:全面扫描与基线建立。 使用工具的站点抓取功能,对整个网站或核心部分进行一次全面扫描。记录下抓取到的页面总数、发现的问题(错误链接、慢速页面等)和当前的网站结构。这份报告将作为优化的基线。

- 第二步:诊断与修复关键错误。 优先处理工具报告中的硬性错误,如404页面(设置301重定向到相关页面)、500服务器错误(联系主机商解决)、死循环重定向(简化重定向链)等。这些错误会直接阻碍蜘蛛抓取。

- 第三步:优化抓取预算分配。 百度蜘蛛分配给每个网站的抓取资源(抓取预算)是有限的。通过分析工具提供的抓取频率和深度数据,确保蜘蛛将宝贵的时间用在刀刃上。具体做法包括:强化重要页面(如首页、分类页、核心内容页)的内链建设;使用规范的链接(避免动态参数过长过杂);利用nofollow标签引导蜘蛛忽略无关链接(如登录、注册链接)。

- 第四步:提升内容可抓取性与质量。 确保重要的文字内容直接包含在HTML源代码中,而非完全依靠JavaScript渲染。检查图片是否配有ALT文本,视频是否有文字说明。同时,正如许多专家在 中所强调的,确保页面内容独特、丰富且相关,这才是吸引蜘蛛频繁访问并给予高排名的根本。

- 第五步:持续监控与迭代。 SEO优化不是一劳永逸的。应定期(如每月或每季度)使用抓取工具进行复查,监控网站结构变动后蜘蛛的适应情况,以及新内容是否被及时收录。利用百度搜索资源平台的“抓取诊断”等官方工具进行补充验证。

四、注意事项与最佳实践

在使用百度蜘蛛抓取工具时,也需注意以下要点:

- 尊重服务器负荷: 配置扫描时,注意设置合理的请求间隔和并发数,避免对生产服务器造成过大压力,甚至被误判为CC攻击。

- 结合官方工具: 第三方工具虽功能强大,但仍需与百度搜索资源平台(原百度站长平台)结合使用。官方的“抓取诊断”、“索引量”、“死链提交”等功能是直接与百度搜索引擎交互的,数据最为权威。

- 关注移动适配: 在移动优先索引的时代,务必使用工具模拟百度移动蜘蛛的抓取,检查网站的移动端页面是否正常,结构化数据是否一致。

- 理解工具局限: 模拟抓取的结果与百度蜘蛛真实抓取可能存在细微差异,且工具无法完全模拟百度复杂的排名算法。它主要解决的是“抓取”和“索引”层面的问题。

结论:让技术赋能SEO战略

在SEO从“艺术”走向“科学”的今天,数据驱动的决策变得愈发重要。百度蜘蛛抓取工具正是将不可见的爬虫行为转化为可视化、可分析数据的关键桥梁。通过系统性地使用这类工具,网站管理者能够跳出主观猜测,精准定位技术性SEO问题,优化网站的基础架构,从而为高质量内容的收录和排名铺平道路。

无论是大型企业站点的运维团队,还是个人站长,都应该将百度蜘蛛抓取工具纳入日常的SEO工具包。正如在资源丰富的

中所能学到的那样,持续学习并善用先进工具,是在瞬息万变的搜索引擎优化领域保持竞争力的不二法门。从理解蜘蛛开始,让你的网站在百度搜索的星辰大海中,占据更耀眼的位置。

暂无评论内容