在搜索引擎优化(SEO)的漫长征途中,网站管理员与搜索引擎之间,仿佛在进行一场无声的对话。我们精心构建内容、优化结构,期望能被搜索引擎看见、理解并推荐。而这场对话最重要的“信使”,便是搜索引擎的爬虫程序。对于中文互联网世界而言,百度蜘蛛(Baiduspider)无疑是这位最关键的信使。理解它、分析它的行为,是网站获得百度搜索引擎青睐的基石。本文将深入探讨专业的百度蜘蛛抓取工具,解析其如何从幕后走向台前,成为每一位SEO从业者与网站主不可或缺的利器。

引言:与百度蜘蛛的“单向玻璃”

许多站长都有过这样的困惑:网站更新了大量优质内容,为什么在百度上的收录和排名却迟迟没有动静?我们与百度蜘蛛之间,似乎隔着一层“单向玻璃”——我们能看到蜘蛛的到来(通过服务器日志),却无法确切知道它“看到了什么”、“感受到了什么”、以及“为何离开”。这种信息不对称常常导致SEO工作事倍功半。传统的分析方式,如查看服务器日志,虽然原始但门槛较高且数据冰冷。而现代百度蜘蛛抓取工具的出现,正是为了打破这层玻璃,将蜘蛛的抓取行为可视化、数据化、可分析化,让我们能够以蜘蛛的视角重新审视自己的网站。

核心功能解析:工具如何照亮蜘蛛的爬行路径

一款优秀的百度蜘蛛抓取工具,绝非简单的访问模拟器。它整合了多项关键功能,旨在全方位诊断网站的健康状况与抓取友好度。

1. 抓取频率与深度模拟

这是工具最基础也是最核心的功能。它能够模拟百度蜘蛛的正式抓取请求(包括User-Agent标识),向目标URL发起访问,并完整记录整个抓取过程。工具会返回服务器状态码(如200成功、404未找到、500服务器错误)、响应时间、下载页面大小等关键数据。更重要的是,它能分析此次抓取的“深度”,即从首页出发,需要经过几次点击才能到达该页面。这有助于站长发现那些结构过深、蜘蛛难以触达的重要内容,从而优化网站的内部链接结构。

2. 抓取异常诊断与渲染对比

现代网站大量使用JavaScript、AJAX等技术,这对搜索引擎爬虫的理解能力构成了挑战。高级的百度蜘蛛抓取工具具备“渲染”功能。它不仅能抓取原始HTML代码,还能像浏览器一样执行页面中的JavaScript,生成最终用户看到的“渲染后”的DOM内容。通过对比“抓取HTML”与“渲染后HTML”,可以精准定位哪些内容是因为JS加载而未被蜘蛛获取的,从而指导前端进行SEO友好化改造。此外,工具能清晰诊断重定向链(如301/302)、屏蔽指令(如robots.txt、meta noindex)等问题,避免因技术设置失误导致内容不被抓取。

3. 站点地图(Sitemap)分析与URL提交

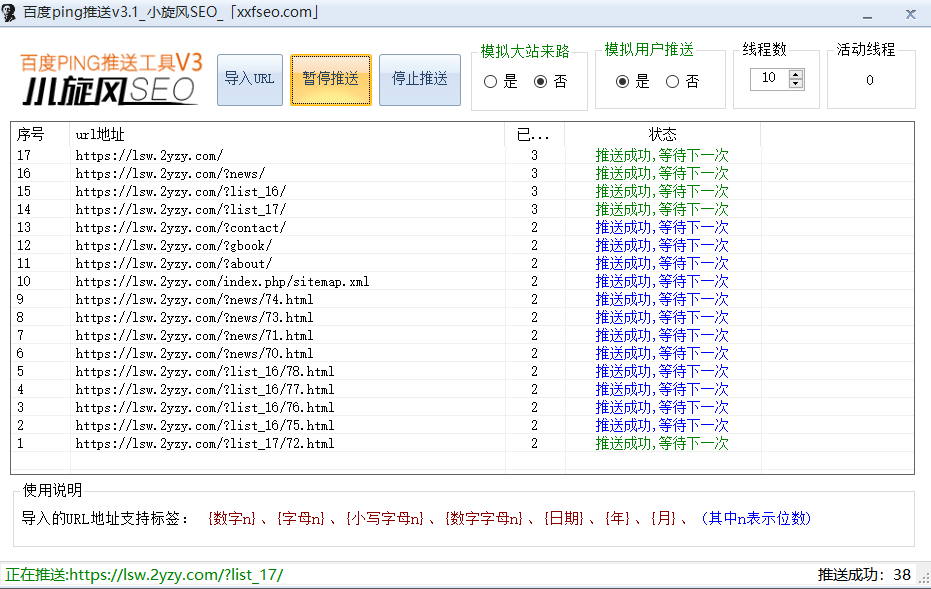

工具可以解析并验证网站提交的Sitemap.xml文件,检查其中包含的URL是否可访问、是否存在重复或错误。更为强大的是,许多工具集成了与百度搜索资源平台(原站长平台)的API接口,允许用户直接将重要的、新产生的URL一键提交给百度蜘蛛,主动邀请其来抓取,极大缩短了新内容被发现索引的周期。

4. 索引状态查询与覆盖率报告

抓取不等于收录。工具可以对接百度搜索资源平台的数据,提供网站页面的索引状态概览,展示已收录、未收录、索引异常(如重复、低质)的页面数量与示例。生成可视化的覆盖率报告,帮助站长宏观把控网站在百度数据库中的存在状况,集中资源解决索引问题。

实战应用:从数据到决策的SEO闭环

拥有工具只是第一步,更重要的是利用其提供的数据驱动SEO决策。

案例一:解决“收录瓶颈”

某内容型网站发现文章收录率持续下降。通过百度蜘蛛抓取工具批量模拟抓取未被收录的页面,发现大量页面返回状态码为“200”,但抓取时间异常长(超过3秒)。进一步诊断发现是某个第三方评论插件加载缓慢拖累了整个页面。优化该插件后,抓取时间降至1秒内,一段时间后,收录率显著回升。

案例二:优化单页应用(SPA)

一个采用Vue.js框架的单页应用在百度上排名几乎为零。工具渲染对比显示,蜘蛛抓取的HTML几乎为空,所有内容都需JS执行后才出现。技术团队根据工具指引,实施了服务端渲染(SSR)方案。再次使用工具验证,蜘蛛已能成功抓取到完整的渲染后内容,为后续的收录和排名奠定了基础。

案例三:发现宝藏内容

通过工具的站点地图分析功能,某电商站发现自己一个包含大量长尾关键词的“产品对比指南”聚合页,竟然因为一个错误的robots.txt规则被意外屏蔽。解除屏蔽并通过工具主动提交后,该页面迅速被收录,并带来了可观的精准搜索流量。

工具的局限与伦理使用

必须清醒认识到,百度蜘蛛抓取工具是辅助分析手段,而非万能钥匙。首先,它模拟的抓取频率和压力与实际百度蜘蛛的分布式抓取有所不同,过度频繁的测试请求可能对服务器造成负担,甚至被误判为攻击。其次,工具提供的“渲染”能力可能与百度蜘蛛最新的解析能力存在细微差异,需以百度搜索资源平台的官方指南和工具(如“URL提交”和“移动友好度测试”)为最终参考标准。

在使用伦理上,工具应用于自身网站的优化诊断,切勿用于恶意抓取、扫描或攻击他人网站。尊重robots协议,健康合法地运用技术,才是长久之计。

结论:从被动等待到主动协同

在搜索引擎优化已进入精细化、技术化时代的今天,仅凭经验和感觉做SEO无异于盲人摸象。百度蜘蛛抓取工具的价值,在于它将不可见的抓取过程变为可见的数据流,将猜测变为确证,将被动等待蜘蛛光临变为主动排查与邀请。它不仅是诊断问题的“听诊器”,更是规划网站信息架构、指导技术开发的“导航仪”。

对于致力于在百度搜索引擎获得成功表现的网站而言,深入理解并善用这类工具,意味着与百度蜘蛛从“陌生人”转变为“协作伙伴”。您可以通过权威资源如来获取或深入了解此类工具的最新信息与最佳实践。唯有如此,我们才能确保精心创作的内容,能够畅通无阻地被最重要的中文搜索引擎信使发现、传递,最终抵达广大用户的眼前,实现内容价值的最大化。

暂无评论内容