在互联网这片浩瀚的信息海洋中,一个网站建立得再精美,功能再强大,若无法被搜索引擎发现和索引,便如同在深海中埋没的宝藏,无人知晓。而连接网站与搜索引擎的核心桥梁,正是我们常说的“网络爬虫”或“蜘蛛”。对于中文互联网世界而言,百度蜘蛛(Baiduspider)无疑是其中最重要的一位访问者。如何有效管理和引导这位关键访客,确保网站内容被高效、准确地抓取,就成了每位网站运营者、SEO从业者必须掌握的课题。本文将深入探讨百度蜘蛛抓取工具,解析其工作原理、官方工具的使用以及优化抓取效率的实战策略。

引言:搜索引擎的“侦察兵”

想象一下,搜索引擎就像一个试图绘制全球图书馆地图的庞大系统。它无法瞬间知晓每个图书馆(网站)里新增或减少了哪些书籍(网页)。这时,它需要派出无数的“侦察兵”——蜘蛛程序,去逐个访问图书馆,记录书名、目录和内容概要,并将信息带回中心数据库进行整理编目。百度蜘蛛,正是百度搜索引擎派出的核心侦察兵。它的抓取效率和质量,直接决定了你的网站内容能否进入百度的索引库,进而影响其在搜索结果中的排名与展现。

第一部分:认识百度蜘蛛与其工作机制

百度蜘蛛是一个自动运行的软件程序,它遵循特定的算法,日夜不停地穿梭于亿万个网页之间。它的基本工作流程可以概括为“发现-抓取-解析-存储”。

- 发现:蜘蛛从已知的种子URL(如重要门户网站、已收录的高质量站点)开始,通过解析页面上的超链接(Href),像滚雪球一样不断发现新的URL。

- 抓取:访问发现的URL,下载网页的HTML代码及其他相关资源(如CSS, JavaScript)。这就是百度蜘蛛抓取的核心动作。

- 解析:对抓取到的内容进行分析,提取文本信息、关键词、链接结构、元数据(如标题、描述)等。

- 存储:将处理后的数据送入百度的索引系统,为后续的用户查询提供匹配基础。

这个过程看似自动,实则网站方并非完全被动。通过使用百度蜘蛛抓取工具及相关协议,我们可以主动向百度“招手”,引导蜘蛛更智能、更高效地工作。

第二部分:核心工具全景:百度搜索资源平台

百度为网站管理者提供了一站式的官方管理平台——百度搜索资源平台(原名百度站长平台)。这里集成了所有关键的百度蜘蛛抓取工具和诊断功能,是管理蜘蛛与网站交互的“控制中心”。

1. 抓取诊断工具

这是最直接的工具之一。你可以输入一个具体的网站URL,模拟百度蜘蛛的抓取过程。工具会返回抓取到的页面HTML代码、抓取状态(成功、失败、遇到重定向等)以及蜘蛛在抓取过程中看到的实际内容(即渲染前的源码)。这对于验证蜘蛛能否正常访问某个页面、检查页面是否存在对蜘蛛的屏蔽(如Robots.txt、Noindex标签)、排查加载问题(如JS渲染问题)至关重要。例如,当你发现某个重要页面迟迟不被收录时,先用此工具诊断,往往能快速定位问题。

2. Robots文件生成与检测

Robots.txt是网站与蜘蛛沟通的第一份“协议”,它放置在网站根目录下,用于告诉蜘蛛哪些目录或文件可以抓取,哪些应该避开。百度搜索资源平台提供了可视化的Robots文件生成工具,即使不懂语法,也能通过勾选轻松生成规则。同时,其检测工具可以验证你的Robots.txt文件是否书写正确,是否意外屏蔽了重要资源。

3. 网站地图(Sitemap)提交

如果说Robots.txt是“禁令列表”,那么Sitemap就是“优先推荐清单”。它是一个包含网站所有重要URL及其元数据(如更新频率、优先级)的XML文件。通过平台提交Sitemap,你可以主动、快速地将网站的最新结构和内容变化告知百度蜘蛛,尤其对于拥有大量页面、深层链接或动态内容的网站,这是促进收录的强力手段。平台会显示Sitemap的提交状态、包含的URL数量以及已被成功抓取的数量。

4. 死链提交与抓取频次调整

网站难免会产生一些失效的“死链”(404页面)。大量死链不仅影响用户体验,也会浪费蜘蛛的抓取配额。通过死链提交工具,你可以将死链列表提交给百度,帮助其快速从索引中清除,从而将抓取资源集中在有效页面上。此外,对于大型网站,你甚至可以申请调整百度蜘蛛的抓取频次,但这需要网站具备足够的内容更新速度和服务器承载能力来证明其必要性。

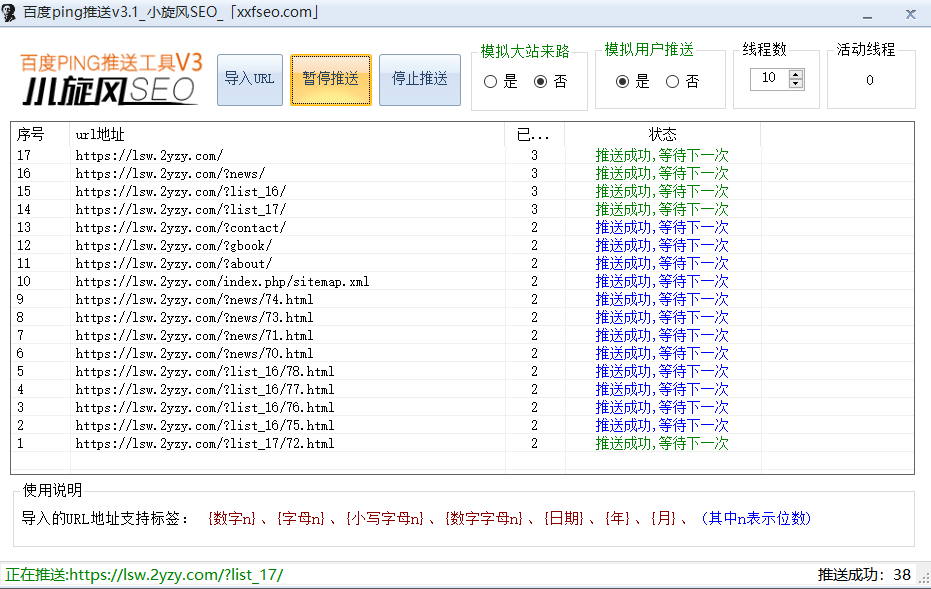

5. 深入学习的参考

对于希望深入理解百度蜘蛛最新动态和抓取策略的开发者,关注百度搜索资源平台的官方公告和文档是必不可少的。其中会详细解读蜘蛛对新技术(如HTTPS、AMP、MIP)、新格式(如结构化数据、熊掌号/百家号历史接口)的支持情况。网络上也有一些深度分析文章,例如在中,就对百度蜘蛛的抓取优先级算法进行了颇具深度的探讨,值得SEO进阶者参考。

第三部分:超越工具:优化蜘蛛抓取的实战策略

工具是利器,但策略才是灵魂。有效利用百度蜘蛛抓取工具,需要结合以下网站优化策略:

- 网站结构与内部链接优化:构建清晰、扁平、网状链接的网站结构。确保重要页面在首页或重要频道页通过3次以内的点击即可到达。良好的内部链接就像为蜘蛛铺设了四通八达的高速公路网。

- 页面加载速度与性能:蜘蛛每次访问都有时间成本。缓慢的服务器响应、臃肿的页面代码、未优化的图片和脚本都会严重拖累抓取效率。使用百度搜索资源平台的“页面速度分析”工具进行诊断并优化。

- 内容质量与更新频率:蜘蛛更喜欢抓取新鲜、独特、有价值的内容。保持定期、稳定的高质量内容更新,会吸引蜘蛛更频繁地回访。避免大量采集或复制内容。

- 移动友好性:在移动优先索引的时代,确保网站对移动设备友好(响应式设计或独立移动站)是吸引移动版百度蜘蛛的基础。

- HTTPS安全协议:百度明确表示对HTTPS站点给予收录支持。部署SSL证书,启用HTTPS,不仅能提升安全性,也可能对搜索引擎抓取和排名带来积极影响。

结论:与百度蜘蛛建立良好“合作关系”

总而言之,百度蜘蛛抓取工具并非神秘的黑匣子,而是百度官方提供的、用于促进搜索引擎与网站健康互动的透明化窗口。从基础的Robots协议、抓取诊断,到进阶的Sitemap提交、死链管理,这些工具构成了我们主动管理网站收录状态的武器库。

然而,工具的有效性建立在扎实的网站基础之上。一个逻辑清晰、访问迅速、内容充实的网站,本身就是对百度蜘蛛最友好的邀请函。将官方工具与持续的网站优化实践相结合,意味着你不再是搜索引擎算法的被动接受者,而是能够主动引导流量、提升能见度的积极管理者。理解并善用这些工具,就是确保你的网站世界被百度这位最重要的“地图绘制者”清晰、完整、优先“看见”的关键一步。在这个信息过载的时代,让你的内容被准确抓取和索引,是赢得在线竞争的第一步,也是至关重要的一步。

暂无评论内容