在当今信息爆炸的数字时代,网站能否被搜索引擎,尤其是国内占据主导地位的百度,有效收录和展现,直接关系到其线上生存与发展的命脉。而决定收录效率的第一步,便是搜索引擎的“蜘蛛”(Spider)或“爬虫”(Crawler)能否顺利抓取并理解您的网站内容。对于站长和SEO从业者而言,仅仅被动等待是远远不够的,主动洞察和优化蜘蛛抓取行为至关重要。此时,专业的百度蜘蛛抓取工具便成为了我们手中不可或缺的“探照灯”与“导航仪”。

一、揭开面纱:百度蜘蛛与抓取工具的本质

百度蜘蛛(Baiduspider),是百度搜索引擎自动访问互联网、收集网页信息的程序。它不知疲倦地在网络海洋中穿梭,通过链接发现新页面,并将抓取到的内容带回百度的索引库进行处理,最终用于响应用户的搜索请求。

然而,蜘蛛的抓取过程对网站所有者而言往往是“黑箱操作”。我们无法直观看到:蜘蛛今天来了几次?它成功抓取了哪些页面?又因何种原因放弃了某些内容?为了解决这一信息不对称问题,百度蜘蛛抓取工具应运而生。这类工具的核心功能,便是模拟或真实记录百度蜘蛛的访问行为,让网站管理者能够以“蜘蛛视角”审视自己的网站,从而诊断并解决可能存在的抓取障碍。

二、工欲善其事:为何需要专业的抓取工具?

许多站长可能会有疑问:我直接查看服务器日志不就能看到蜘蛛访问记录了吗?诚然,服务器日志分析是权威的数据来源,但它技术门槛较高,数据庞杂且不易解读。而专业的抓取工具则提供了更友好、更聚焦的分析界面。其核心价值主要体现在以下几个方面:

- 主动诊断抓取可行性: 在内容更新或网站改版后,你可以立即使用工具请求百度蜘蛛前来抓取特定URL,加速新内容被发现的进程,而不是被动等待数周甚至数月。

- 精准发现抓取障碍: 工具能清晰地反馈抓取结果:是成功返回了200状态码,还是遇到了404(页面不存在)、500(服务器错误)或403(禁止访问)等问题?它能帮你识别因Robots.txt设置错误、错误的重定向链、复杂的JavaScript渲染或页面加载过慢等原因导致的抓取失败。

- 理解蜘蛛所见即所得: 蜘蛛看到的页面内容与用户在浏览器中看到的是否一致?工具可以渲染并展示蜘蛛抓取到的HTML源代码,帮你排查因技术设置(如错误使用AJAX加载主要内容)导致的关键内容无法被抓取的问题。

- 优化抓取预算分配: 对于大型网站,百度蜘蛛的抓取资源(抓取频次和深度)是有限的。通过分析工具提供的数据,你可以识别出哪些低价值页面(如大量参数重复的页面)占用了过多抓取预算,并通过技术手段进行优化,引导蜘蛛更高效地抓取重要内容。

三、核心工具全景:从官方到第三方

目前,用于分析和优化百度蜘蛛抓取行为的工具主要分为两大类:

1. 百度官方利器:百度搜索资源平台

这是最权威、最直接的渠道。在平台的“链接提交”模块中,提供了“抓取诊断”工具。你可以输入任意一个属于你站点的URL,选择模拟“百度蜘蛛”进行抓取。该工具会实时返回抓取状态、HTTP头信息以及蜘蛛抓取到的页面源代码。这是验证网站能否被百度正常访问的“黄金标准”。

此外,平台内的“抓取频次”工具可以查看百度蜘蛛对你网站的历史访问趋势,虽然不提供实时调整功能,但对于了解网站整体吸引力非常有帮助。“Robots”工具则能在线检测和生成Robots.txt文件,确保指令正确无误。

2. 强大的第三方辅助工具

官方工具虽好,但在深度分析、批量处理和模拟抓取策略上有时存在局限。因此,许多专业的SEO平台或软件提供了功能更全面的百度蜘蛛抓取工具。这些工具往往具备以下增强功能:

- 深度爬取与网站结构分析: 可以像蜘蛛一样遍历全站,绘制出完整的网站地图,直观展示内部链接结构,发现孤岛页面或过深的目录层级。

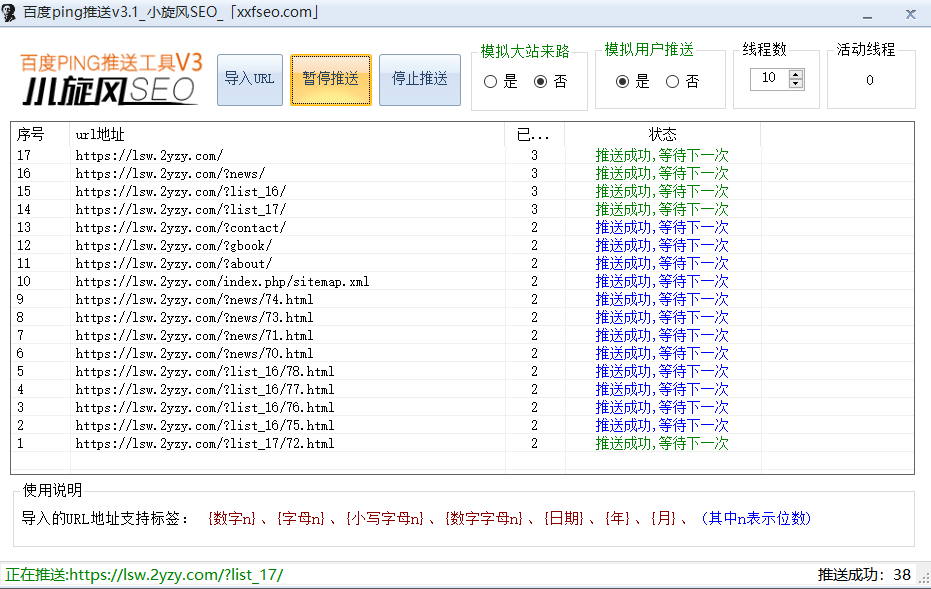

- 批量URL检查与监控: 支持导入成千上万的URL列表,批量检查其可抓取性、标题和元描述,并建立监控任务,持续跟踪变化。

- 高级渲染与JS执行: 能够更好地模拟现代浏览器环境,执行JavaScript代码,从而准确判断那些依赖前端渲染的页面(如Vue.js、React构建的SPA应用)是否真的能被蜘蛛抓取到核心内容。

- 可视化报告与问题汇总: 将发现的各类问题(如死链、慢速页面、缺失标签等)分类整理,生成 actionable(可操作)的报告,极大提升优化效率。

例如,在专业SEO分析工具中,你可以找到针对百度蜘蛛的深度模拟选项,其分析结果常常能提供更细致的优化洞见。一些站长在使用了类似 这类资源站推荐的工具后,反馈其批量处理和渲染能力有效提升了他们的诊断效率。

四、实战应用:让抓取工具驱动SEO增长

拥有了工具,关键在于如何将其融入日常的SEO工作流。以下是一个典型的应用闭环:

- 上线前检查: 在新页面或新站发布前,使用抓取工具进行“预检”,确保蜘蛛可访问、核心内容在源码中清晰可见、标题和描述标签无误。

- 日常监控与诊断: 定期(如每周)使用工具对重要页面或动态生成的页面(如产品列表、搜索结果页)进行抓取测试,及时发现因程序改动或数据异常导致的抓取问题。

- 解决收录问题: 当发现某些页面在百度中搜索不到时,第一步就是用抓取工具检查该URL。如果工具显示抓取失败或内容异常,则根据错误信息进行技术修复(如修正服务器配置、开放Robots限制、优化代码结构)。如果工具显示抓取正常但依旧不收录,则可能需考虑页面内容质量、站点权重或索引配额等问题。

- 优化网站结构: 利用工具的网站爬取功能,分析全站链接网络。强化重要页面的内链支撑,减少无效跳转(如点击多次才能到达内容页),确保蜘蛛能在3次点击内到达网站任何重要页面。

- 提交与跟踪: 修复问题后,通过百度搜索资源平台的“链接提交”功能主动推送URL,并持续使用抓取工具验证效果,形成“诊断-修复-验证”的优化循环。

五、超越工具:正确的认知与策略

必须清醒认识到,百度蜘蛛抓取工具是强大的诊断器,而非“收录加速器”的万能钥匙。它的作用是扫清技术层面的障碍,为高质量内容被索引铺平道路。工具的效能,最终建立在以下基础之上:

- 网站基础体验是根本: 稳定的服务器、快速的加载速度(尤其是移动端)、清晰的HTML语义化结构,是蜘蛛顺畅抓取的前提。工具会暴露这些问题,但解决它们需要扎实的技术投入。

- 内容是终极王道: 工具能帮你确保页面被抓取,但无法决定页面是否被索引和排名。原创、优质、满足用户需求的内容,配合清晰的内容主题架构,才是吸引蜘蛛频繁访问并给予高权重的核心。

- 生态与合规: 遵守百度的搜索优化指南,远离任何作弊手段。利用工具的目的是优化用户体验和蜘蛛友好度,而非操纵抓取。一个健康、持续提供价值的网站,自然会获得蜘蛛的青睐。

结语

在搜索引擎优化这场没有硝烟的战争中,信息即权力。百度蜘蛛抓取工具正是赋予我们洞察“蜘蛛视角”权力的关键装备。它将抽象的抓取过程具象化、数据化,使我们能够从被动等待转为主动管理,从模糊猜测转为精准优化。无论是善用百度搜索资源平台的内置工具,还是借助更强大的第三方专业平台,其目的都是一致的:打通网站内容与百度索引库之间的“最后一公里”,确保每一个精心创作的价值页面,都能畅通无阻地抵达搜索引擎,并最终呈现给有需要的用户。将抓取工具融入日常运维,是每一位追求长期稳健SEO效果的网站运营者的必备素养和明智选择。

暂无评论内容