在搜索引擎优化(SEO)的浩瀚世界中,理解搜索引擎如何发现、抓取和索引网页是成功的基石。对于中文互联网生态而言,百度作为主要的搜索引擎,其抓取机制——特别是由“百度蜘蛛”(Baiduspider)这一爬虫程序所执行的工作——更是每一位网站管理员、内容创作者和SEO从业者必须精通的课题。本文将深入探讨百度蜘蛛抓取工具的核心原理,并结合实战案例,为您提供一套完整的应用与优化策略。

引言:看不见的“数字园丁”

想象一下,互联网是一个无限延伸、每分每秒都在疯狂生长的巨型图书馆。百度蜘蛛,就像是图书馆派出的最勤奋、最专业的园丁兼采购员。它不知疲倦地穿梭于各个“书架”(服务器)之间,识别新出版的“书籍”(新网页),检查旧书是否有修订版(内容更新),并评估每本书的价值与归类(内容质量与相关性)。而我们所说的百度蜘蛛抓取工具,本质上就是一系列用于模拟、监测、分析和优化这个“蜘蛛”行为的工具与方法的集合。理解并善用这些工具,意味着你能够主动为蜘蛛铺平道路,确保你的网站内容被高效、准确、完整地收录,从而在搜索结果的竞争中抢占先机。

第一部分:百度蜘蛛的工作原理与抓取机制

要有效利用工具,首先需理解工具所服务的对象。百度蜘蛛的抓取遵循一套复杂的算法逻辑,但其核心流程可概括为以下几个环节:

- 发现链接:蜘蛛从已知的网页(尤其是高权重、更新频繁的网站)出发,通过页面上的超链接(href)不断发现新的URL。这也是为什么外链建设和网站内部结构如此重要的原因。

- 排队与调度:发现的URL会进入抓取队列。百度会根据网站的历史表现、服务器负载能力、页面更新频率、重要性等众多因素,动态调整对不同站点及页面的抓取频率和深度。

- 抓取与渲染:蜘蛛访问URL,下载页面的HTML代码。现代搜索引擎蜘蛛(包括百度)都具备一定程度的渲染能力,能够解析JavaScript生成的内容,但这比抓取静态HTML耗费更多资源且可能不及时。

- 内容提取与分析:从抓取到的内容中提取文本、链接、多媒体信息以及元数据(如标题、描述),进行初步的内容质量与相关性分析。

在这个过程中,百度蜘蛛抓取工具的作用便是让我们能够窥探、干预和优化上述环节。例如,通过百度搜索资源平台(原百度站长平台)提供的“抓取诊断”工具,我们可以即时测试蜘蛛能否成功访问某个页面,并查看其抓取到的具体内容,这直接对应了抓取与渲染环节的诊断。

第二部分:核心工具与功能实战应用

百度官方为网站管理者提供了一整套强大的工具集,它们是百度蜘蛛抓取工具的核心组成部分。

1. 百度搜索资源平台:你的控制中心

这是与百度蜘蛛交互最权威的平台。关键功能包括:

- 站点管理:提交网站,验证所有权,是使用所有功能的前提。

- 抓取诊断:模拟百度蜘蛛对任一URL进行抓取,并返回抓取结果、HTTP状态码和抓取到的页面HTML。这是排查“蜘蛛看到的内容与用户看到的不一致”问题的利器,尤其适用于检测因JS渲染、 robots.txt误屏蔽、服务器封禁等导致的抓取失败。

- 死链提交:主动向百度提交网站上的失效链接,有助于加快清理索引库中的死链,避免权重流失和不良用户体验。

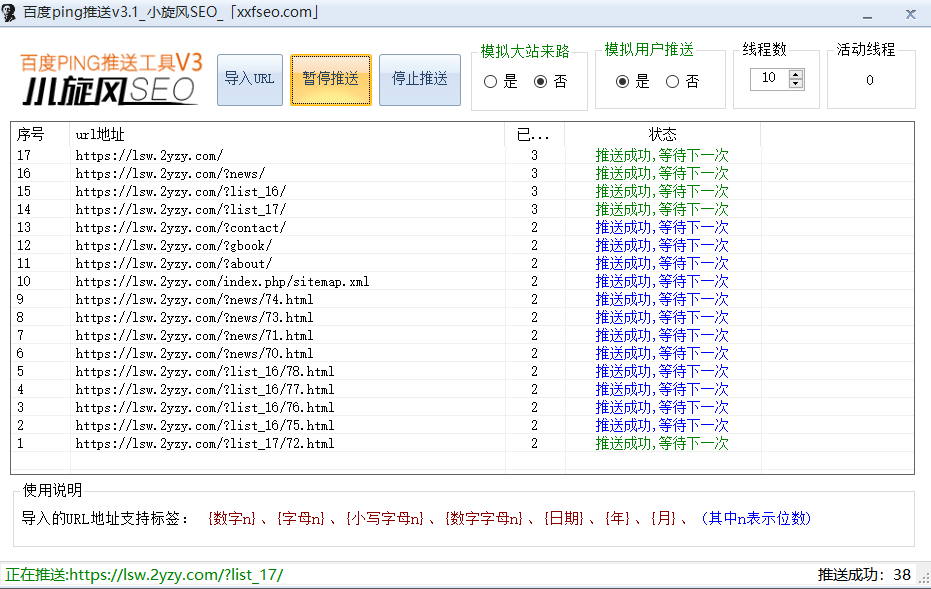

- 链接提交:包括主动推送(实时)、手动提交(sitemap)和自动推送(代码部署)。这是主动向蜘蛛“喂食”新链接,促进发现和抓取速度最有效的方式。一个高效的链接提交策略,能显著缩短新内容的收录时间。

2. 日志分析:最真实的抓取记录

服务器日志文件记录了每一次访问的详细信息,包括百度蜘蛛的每一次抓取。分析日志是百度蜘蛛抓取工具中最高阶、最真实的方法。通过日志分析,你可以:

- 精确了解百度蜘蛛的来访频率、抓取页面数量。

- 发现蜘蛛抓取了哪些无意义的页面(如参数过多的重复页面),从而进行URL规范化或屏蔽。

- 识别抓取错误(4xx,5xx状态码),及时修复。

- 对比不同页面的抓取深度和频率,评估网站结构是否合理。

市面上有许多专业的日志分析工具,也可以使用如ELK Stack等开源方案自行搭建。深入分析日志数据,能让你从被动的观察者变为主动的调度者。

3. Robots.txt文件与Meta Robots标签:抓取指令

这是给蜘蛛的“交通指示牌”。通过合理配置`robots.txt`文件,你可以禁止蜘蛛抓取某些目录或文件(如后台、登录页、无限参数页面)。而通过页面HTML头部的`meta robots`标签,可以更精细地控制单个页面的索引和跟踪行为(如`noindex, follow`)。正确使用这些指令,是优化抓取预算、引导蜘蛛关注核心内容的基础。

第三部分:高级优化策略与常见问题

掌握了工具,更需要有策略地使用它们。以下是一些基于百度蜘蛛抓取工具应用的高级优化思路:

策略一:优化抓取预算,引导蜘蛛至价值页面

蜘蛛对单个网站的抓取资源(抓取预算)是有限的。应确保蜘蛛将宝贵的抓取次数用在“刀刃”上——即你希望被收录和排名的核心内容页。通过日志分析找出被大量抓取的低价值页面(如过滤页面、会话ID页面),并使用`robots.txt`或`nofollow`进行限制。同时,通过优化内部链接结构,确保重要页面在网站中有充足的入口和较浅的点击深度。

策略二:确保内容可抓取性与可索引性

这是百度蜘蛛抓取工具诊断的核心价值。定期使用“抓取诊断”工具检查关键页面。特别关注:

- JS/AJAX加载的内容:蜘蛛的渲染有延迟和限制。对于关键内容,尽量使用服务器端渲染(SSR)或预渲染(Prerendering)技术。

- 移动端适配:百度优先索引移动端内容。确保网站在移动设备上可正常访问,且内容与PC端一致。

- 页面加载速度:过慢的加载速度会导致抓取超时或中断。优化图片、代码,使用CDN,是保障抓取成功的基础。

策略三:善用数据反馈,形成优化闭环

将百度搜索资源平台的数据(索引量、抓取频次、流量与关键词数据)与服务器日志分析相结合。例如,当发现某个重要栏目的索引量下降时,立即通过抓取诊断和日志分析排查原因:是产生了大量死链?还是页面模板改动导致无法抓取?或是服务器不稳定?迅速定位问题并修复。

常见问题与误区

在实践中,有几个常见误区需要避免:

- 过度屏蔽:在`robots.txt`中过度限制,导致重要CSS、JS文件无法被抓取,影响页面渲染判断。

- 提交无效内容:向百度主动推送大量低质量、重复或空洞的页面,可能会浪费配额甚至引来负面评价。

- 忽视日志:仅依赖平台工具,不查看原始日志,会错过大量深层问题线索。

对于希望获得更系统化工具指导和实战案例的读者,可以参考一些专业的SEO资源站,例如在分析网站结构优化时,

提供过非常详尽的图文教程和工具推荐,将理论落到了具体操作层面。结论:从被动等待到主动管理

百度蜘蛛抓取工具并非一个单一的软件,而是一个涵盖官方平台、日志分析、协议指令和应用策略的综合体系。它的终极目标,是帮助我们化身为网站的“首席架构师”和“交通指挥官”,主动管理百度蜘蛛的抓取行为。

在这个内容为王的时代,再优质的内容如果无法被搜索引擎高效抓取和索引,也如同明珠蒙尘。通过深入理解百度蜘蛛的工作原理,熟练运用各类抓取诊断与优化工具,并实施科学的抓取预算分配策略,我们可以确保网站的核心价值被充分“看见”和“理解”。从今天起,停止盲目猜测,开始用数据和工具说话,将百度蜘蛛从神秘的访客转变为受你引导的合作伙伴,共同耕耘网站在搜索引擎中的丰硕成果。

暂无评论内容