在当今数字化时代,网站的可见性与流量是衡量其成功与否的关键指标。而这一切的基石,在于搜索引擎能否准确、高效地发现和理解网站内容。对于广大中文网站而言,百度搜索引擎无疑是流量获取的主阵地。要让百度更好地“认识”你的网站,就离不开一个核心角色——百度蜘蛛,以及辅助我们理解和优化蜘蛛行为的百度蜘蛛抓取工具。本文将为您深入剖析这一工具的核心功能、应用场景及实战技巧,助您提升网站在百度搜索结果中的表现。

引言:认识网络世界的“信息采集员”

想象一下,百度就像一个拥有海量图书的超级图书馆,而互联网上的每一个网页都是一本待收录的书。百度蜘蛛(Baiduspider)就是这个图书馆派出的“图书采购员”和“编目员”,它不知疲倦地在浩瀚的网络世界中爬行,访问一个又一个链接,将网页内容带回百度的数据库进行索引。这个抓取过程是您的网站内容能够出现在搜索结果中的第一步,也是至关重要的一步。

然而,蜘蛛的抓取资源(如带宽、时间)是有限的。如果网站存在结构复杂、加载缓慢、存在死链或屏蔽抓取等问题,蜘蛛可能无法有效抓取重要内容,导致索引不全,从而影响排名和流量。这时,百度蜘蛛抓取工具便成为了网站管理员、SEO从业者与百度蜘蛛沟通的桥梁和“望远镜”,让我们能够主动诊断、提交并优化抓取过程。

百度蜘蛛抓取工具的核心功能解析

百度为网站管理者提供了官方平台——百度搜索资源平台(原名百度站长平台),其中集成了多款强大工具。我们通常所说的百度蜘蛛抓取工具,主要指的是该平台下的“抓取诊断”和“链接提交”等功能模块。它们共同构成了一个完整的抓取管理闭环。

1. 抓取诊断:蜘蛛视角的实时模拟

这是最具代表性的工具之一。它允许您模拟百度蜘蛛对指定URL的抓取过程,并提供详细的诊断报告。其核心价值在于:

· 还原抓取现场: 工具会使用真实的百度蜘蛛IP(如123.125.71.*)和User-Agent去访问您输入的URL,并将抓取到的原始HTML代码、页面头信息(Header)及最终抓取状态(成功、失败、超时等)呈现给您。这就像您亲自扮演了一次百度蜘蛛,能直观地看到蜘蛛“眼中”的页面是什么样子。

· 诊断抓取障碍: 如果模拟抓取失败或返回异常状态码(如404、500、403),工具会明确提示。这有助于快速定位因服务器故障、Robots.txt屏蔽、登录限制、网络不稳定等原因导致的抓取问题。

· 核对页面内容: 通过查看抓取回的HTML,可以确认百度蜘蛛是否成功抓取到了关键内容,特别是对于大量使用JavaScript渲染的页面,可以检查蜘蛛是否能够正常执行JS并获取内容。

2. 链接提交:主动为蜘蛛“引路”

等待蜘蛛自然发现链接是一个被动且可能缓慢的过程。链接提交工具则提供了几种主动推送方式,加速内容的索引:

· 主动推送(实时): 最高效的方式。通过API接口,网站在内容更新后立即将URL推送给百度,理论上可使内容在几分钟内进入抓取队列。这对于新闻站点、电商上新等时效性强的场景至关重要。

· 手动提交: 最简单直接的方式,适用于少量新链接的提交。您只需将URL复制粘贴到平台的输入框中即可。例如,当您精心撰写了一篇新文章后,可以立即通过手动提交告知百度。

· Sitemap提交: 提交XML格式的网站地图文件。Sitemap像一份给百度蜘蛛的“全站导航图”,列出了网站上所有重要页面的URL及其更新频率、优先级等元数据,帮助蜘蛛更系统、更全面地抓取。通常,在构建网站时,许多内容管理系统(CMS)插件或模块可以自动生成Sitemap,您只需将其地址提交到百度平台。

· 自动推送: 通过在网站的每个页面的HTML代码中嵌入一段特定的JavaScript代码,当用户访问页面时,代码会自动执行并将该页URL推送给百度。这是一种被动的、但覆盖范围较广的补充方式。

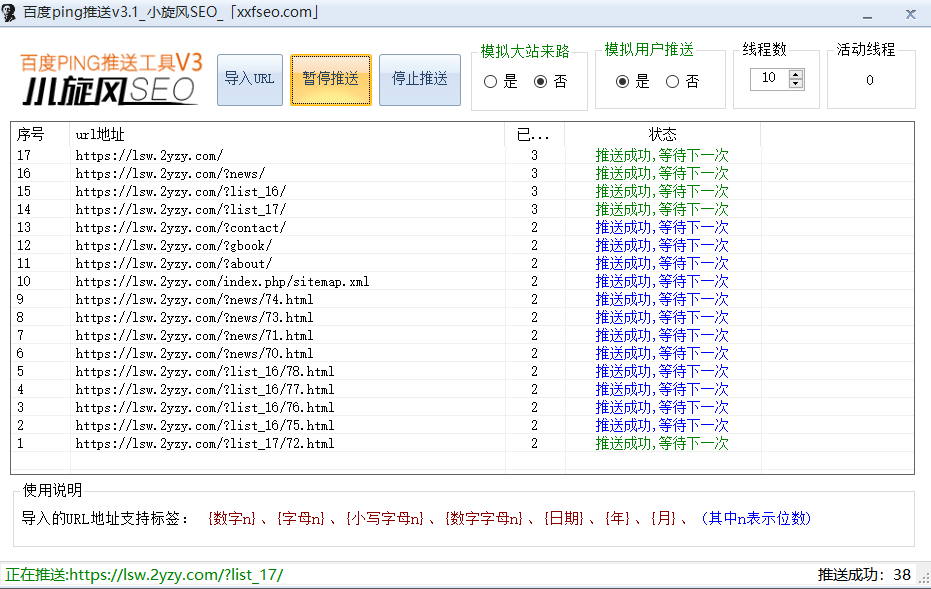

值得注意的是,一个优秀的网站建设者通常会集成这些推送功能。以一款优秀的工具为例,它可能内置了便捷的提交接口,帮助您无缝对接百度搜索资源平台,简化SEO工作流。例如,在管理后台,您可能会看到类似 这样的集成模块或设置项,它代表了该工具对百度链接提交API的良好支持。

实战应用:善用工具优化网站抓取

掌握了工具的功能,关键在于如何将其应用于日常网站运营和SEO优化中。以下是一些实战场景与技巧:

场景一:新站上线或网站改版后

新网站犹如互联网海洋中的孤岛,蜘蛛很难主动发现。此时,应第一时间将网站首页通过“手动提交”或“主动推送”提交给百度。同时,立即生成并提交完整的Sitemap文件,引导蜘蛛快速抓取全站结构。对于改版网站,尤其是URL结构发生变化的,更需要利用抓取诊断工具,逐一检查重要页面的新URL是否能被正常抓取,避免产生大量死链。

场景二:内容更新频率高的网站

对于博客、资讯站、论坛等,内容更新是生命线。建议部署“主动推送”API,确保每一篇新发布的文章都能在第一时间进入百度的抓取视野。同时,定期(如每周)检查抓取诊断中是否有失败的记录,及时排查因程序错误或服务器问题导致的最新内容无法抓取的情况。

场景三:解决索引量不增或下降的难题

当发现网站收录停滞或下降时,抓取诊断工具是首要的排查手段:

1. 选取样本URL: 选择一些未被收录但你认为重要的页面URL。

2. 执行抓取诊断: 查看抓取是否成功。如果失败,根据错误提示(如“连接超时”、“被Robots屏蔽”、“返回码XXX”)进行针对性修复。

3. 检查Robots.txt和Meta Robots标签: 确保没有无意中通过这些指令屏蔽了重要目录或页面。

4. 分析抓取内容: 对比蜘蛛抓取到的HTML与用户浏览器看到的页面是否一致。如果不一致,可能存在对蜘蛛的內容屏蔽(如通过User-Agent判断后返回精简版)或JS渲染问题。

场景四:优化网站性能与体验

抓取诊断工具返回的信息中,包含“抓取时间”。一个加载缓慢的页面会消耗蜘蛛更多资源,可能导致抓取频率降低。如果发现关键页面抓取时间过长,就需要着手优化服务器响应速度、压缩页面资源、启用缓存等,这不仅能提升蜘蛛抓取效率,更能直接改善用户体验,对SEO有双重益处。

结论:工具是手段,理解与优化是根本

百度蜘蛛抓取工具绝非神秘的黑匣子,而是百度官方赋予网站管理者的一把利器。它让我们从“猜测”走向“洞察”,从“被动等待”走向“主动沟通”。通过抓取诊断,我们得以透视技术层面的抓取障碍;通过链接提交,我们能够高效引导蜘蛛资源。

然而,必须清醒地认识到,工具本身并不能直接提升排名。它的核心价值在于发现问题、验证效果和加速过程。真正的SEO优化,根植于为搜索引擎蜘蛛提供清晰、高效、友好的网站结构和访问环境,同时创造对用户真正有价值的高质量内容。

因此,请将百度蜘蛛抓取工具纳入您的日常网站运维体系,定期使用,形成“诊断-优化-提交-监测”的良性循环。当您能够确保百度蜘蛛畅通无阻地抓取您网站上每一个有价值的页面时,您就已经为网站的长远成功,打下了最坚实的技术基础。记住,让蜘蛛“来得顺、抓得全、看得懂”,是您的内容在百度搜索中脱颖而出的第一步,也是不可逾越的一步。

暂无评论内容