在搜索引擎优化(SEO)的浩瀚世界里,网站的收录是排名和流量的基石。而决定网站内容能否被百度搜索引擎发现、索引并最终呈现给用户的关键角色,便是“百度蜘蛛”(Baiduspider)。对于网站管理员和SEO从业者而言,了解并有效引导这位“数字访客”是必修课。为此,百度官方提供了一系列强大的工具,其中最核心的莫过于各类百度蜘蛛抓取工具。本文将深入解析这些工具的原理、功能与实战应用,助您掌控网站收录的主动权。

一、认识百度蜘蛛:网站的“引路人”

百度蜘蛛,本质上是百度搜索引擎的一个自动化程序。它如同不知疲倦的侦察兵,日夜不息地在互联网的海洋中爬行,通过追踪链接来发现新的网页,并将这些网页的内容和数据抓取回百度的服务器进行存储与分析。这个过程,我们称之为“抓取”(Crawl)。只有被成功抓取的页面,才有机会经过后续的“索引”和“排序”,最终在搜索结果中露面。

然而,蜘蛛的爬行并非毫无章法。它受到网站服务器性能、Robots协议、页面结构、链接质量等诸多因素的限制。如果网站存在加载缓慢、死链众多、结构混乱等问题,蜘蛛的抓取效率就会大打折扣,导致重要页面无法被及时甚至永远无法收录。此时,百度蜘蛛抓取工具便成为了网站与搜索引擎之间沟通的桥梁和管理的利器。

二、百度站长平台:蜘蛛工具的核心阵地

百度提供的绝大多数蜘蛛相关工具,都集成在其官方平台——“百度搜索资源平台”(原百度站长平台)中。这是网站管理员与百度进行数据交换和问题反馈的首要渠道。

1. 抓取诊断工具

这是最常用、最直接的百度蜘蛛抓取工具之一。它允许您模拟百度蜘蛛对网站特定URL进行实时抓取,并立即返回抓取结果。

- 核心功能:

- 模拟抓取:您可以指定一个PC版或移动版的百度蜘蛛(如Baiduspider-render/2.0),对任一URL发起抓取请求。

- 抓取状态反馈:工具会显示HTTP状态码(如200成功、404未找到、500服务器错误),这是判断页面可访问性的根本依据。

- 抓取内容预览:展示蜘蛛眼中看到的页面HTML源代码,这与浏览器渲染后的页面可能不同,帮助您检查JS渲染、重定向等问题。

- 抓取头信息:显示抓取过程中的请求和响应头,有助于诊断Gzip压缩、缓存设置等问题。

- 实战应用:

- 排查收录问题:当某个页面迟迟不被收录时,使用此工具抓取,若返回非200状态码或抓取内容为空,即可定位到服务器端或页面本身的问题。

- 验证Robots和Meta指令:检查蜘蛛是否因Robots.txt禁止或Meta标签(noindex)而无法抓取。

- 测试页面改版效果:在修改页面后,立即模拟抓取,确认蜘蛛能否获取到正确的新内容。

2. 抓取频次工具

此工具用于查看和调整百度蜘蛛对您网站的访问频率。

- 核心功能:

- 频次查看:以图表形式展示历史抓取量的每日趋势,清晰反映蜘蛛的活跃程度。

- 频次调整:如果您认为蜘蛛抓取过于频繁,影响了服务器性能,可以在此提交申请,请求降低抓取压力;反之,如果网站更新快、内容多,也可以申请提升抓取频次。

- 实战应用:

- 服务器负载监控:结合服务器日志,当发现蜘蛛抓取导致CPU或带宽异常时,可考虑临时调低频次。

- 内容更新同步:对于新闻资讯、博客等日更型网站,若抓取量偏低,可尝试申请提高频次,让新内容更快被收录。

3. 死链提交工具 & 抓取异常工具

这两个工具相辅相成,用于处理影响蜘蛛抓取路径顺畅度的问题。

- 死链提交工具:主动将网站上已失效的链接(返回404、410等状态码)以文件或列表形式提交给百度,促使其快速从索引库中清除,避免权重分散和负面体验。

- 抓取异常工具:平台会自动汇总并展示蜘蛛在抓取您网站时遇到的各种异常,如DNS解析失败、连接超时、服务器错误等。这是被动发现网站可用性问题的警报器。

4. Robots工具

虽然Robots.txt是一个标准协议文件,但百度站长平台提供了在线生成、校验和测试的工具。您可以在这里便捷地创建或修改Robots规则,并用百度蜘蛛抓取工具模拟测试规则是否生效,确保不会因配置错误而误封重要内容。

三、实战指南:高效利用蜘蛛抓取工具优化收录

掌握工具是第一步,将其融入日常SEO工作流才能产生价值。以下是一个结合工具使用的实战流程:

步骤一:基础检查与提交

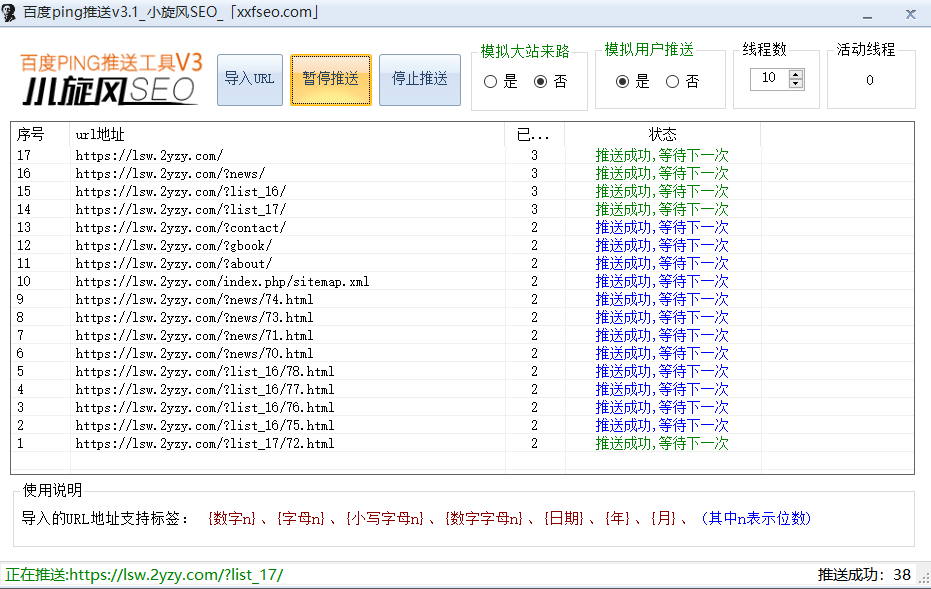

确保网站已在百度搜索资源平台完成验证和站点属性设置。通过“链接提交”中的API、sitemap等方式,主动将新产出或更新的链接推送给百度,为蜘蛛指明爬行方向。

步骤二:定期诊断与监控

每周或每两周,使用“抓取诊断工具”抽查网站的核心页面(如首页、栏目页、重点文章页)。同时,关注“抓取异常”和“抓取频次”报表,及时发现并解决服务器不稳定、网络问题。

步骤三:结构优化与内链建设

蜘蛛顺着链接爬行。一个逻辑清晰、内链丰富的网站结构,如同为蜘蛛铺设了高速路网。确保重要页面在首页或重要导航中有入口,且层级不宜过深(建议不超过3-4次点击)。相关内容间通过内链相互推荐,能有效引导蜘蛛抓取更多页面。在这方面,可以参考一些专业的SEO插件或功能模块,它们能帮助自动化管理内链结构,例如我们曾在分析网站技术架构时提到的 ,其中就涉及了如何通过优化内部链接提升蜘蛛抓取效率的思路。

步骤四:处理抓取障碍

- 对于大量JS/Ajax加载的内容,检查“抓取诊断”中蜘蛛看到的源代码,确保关键内容在HTML中可直接获取,或使用“百度蜘蛛渲染”模拟器测试,必要时考虑采用服务端渲染(SSR)或预渲染技术。

- 及时清理死链,并通过工具提交。

- 检查Robots.txt和页面Meta标签,确保没有不当的禁止指令。

- 优化页面加载速度,过慢的加载会导致蜘蛛抓取超时。

四、进阶思考:超越工具本身

工具是强大的助手,但SEO的成功更依赖于对原则的深刻理解:

- 内容为王:工具能解决“抓得到”的问题,但“是否值得抓”和“是否值得排名”最终取决于内容质量。原创、有价值、满足用户需求的内容,才是吸引蜘蛛频繁来访的根本。

- 体验至上:百度算法越来越注重用户体验。一个移动友好、浏览顺畅、交互自然的网站,不仅能获得用户的青睐,也能获得蜘蛛更好的评价。

- 生态建设:高质量的外部链接(外链)如同其他网站给您的“推荐信”,能吸引蜘蛛从更多入口发现您的网站,提升抓取深度和信任度。

结论

百度蜘蛛抓取工具是每一位网站运营者手中的“显微镜”和“调节器”。它们将不可见的蜘蛛爬行过程变得可视、可测、可控。从基础的抓取诊断到高级的频次调控,这些工具构成了保障网站收录健康度的第一道防线。然而,工具的价值在于使用。唯有将定期使用这些工具纳入SEO运维的常规动作,结合优质内容与良好体验的持续建设,才能与百度蜘蛛建立和谐高效的“合作关系”,让网站的每一份价值都能被搜索引擎发现和认可,从而在激烈的流量竞争中占据先机。记住,驯服蜘蛛,始于工具,成于策略和坚持。

暂无评论内容