引言:洞悉搜索引擎的“侦察兵”

在互联网这片浩瀚的信息海洋中,搜索引擎如同高效的导航系统,而构成这个系统的基石之一,便是被称为“蜘蛛”或“爬虫”的自动程序。它们日夜不息地在万维网中穿梭,发现、抓取并索引网页内容,为用户后续的检索提供素材。对于中文互联网世界而言,百度的蜘蛛无疑是其中最重要的角色之一。理解并善用百度蜘蛛抓取工具,对于网站管理者、SEO从业者乃至内容创作者来说,就如同拿到了与搜索引擎直接对话的钥匙,是提升网站在百度可见性与流量的关键一步。本文将深入浅出地解析百度蜘蛛的运作机制,介绍相关的官方与第三方工具,并提供切实可行的实战指南。

一、 百度蜘蛛概览:定义、类型与工作原理

百度蜘蛛(Baiduspider),是百度搜索引擎用于自动抓取互联网上公开网页内容的程序。它通过跟踪网页间的链接,像蜘蛛在网络上爬行一样,不断发现新的URL,并将抓取到的页面内容带回百度的服务器进行处理和索引。

1.1 主要蜘蛛类型

百度并非只派出一只“蜘蛛”,而是根据任务不同,部署了多个具有不同特性的蜘蛛:

- 通用爬虫(Baiduspider):主力部队,负责日常的全网抓取。

- 移动爬虫(Baiduspider-mobile):专注于抓取和评估移动端页面内容,对于移动优先索引至关重要。

- 图片爬虫(Baiduspider-image):专门抓取和索引图片资源。

- 新闻爬虫(Baiduspider-news):实时抓取新闻资讯类站点。

- 视频爬虫(Baiduspider-video):负责发现和抓取视频内容。

了解这些不同类型,有助于网站管理者通过服务器日志分析,精准识别蜘蛛的访问意图。

1.2 核心工作原理

百度蜘蛛的工作流程可以简化为一个循环:

- 发现URL:从已抓取的页面中提取新的链接,或通过百度搜索资源平台(原百度站长平台)提交的Sitemap获取URL列表。

- 抓取决策:根据网站的robots.txt协议、页面的权重、更新频率、服务器负载等因素,决定是否抓取及抓取优先级。

- 页面抓取:向目标URL发起HTTP请求,下载页面的HTML代码及相关资源(CSS, JS, 图片等)。

- 内容解析与存储:解析下载的内容,提取文本、链接、结构化数据等有效信息,存入临时数据库。

- 链接提取与去重:将新发现的链接加入待抓取队列,并去除重复的URL。

这个过程的效率和质量,直接决定了网页能否被快速、完整地收录。

二、 核心工具详解:百度搜索资源平台

要与百度蜘蛛有效协作,百度搜索资源平台是官方提供的、最权威的工具集。它不仅仅是百度蜘蛛抓取工具的管理后台,更是网站与百度搜索引擎沟通的桥梁。

2.1 “抓取诊断”工具

这是最直接模拟蜘蛛抓取行为的工具。用户可输入任一站内URL,选择PC或移动蜘蛛进行模拟抓取。它能展示:

- 抓取结果:成功与否,返回的HTTP状态码。

- 页面HTML源码:蜘蛛实际看到的代码,可用于检查渲染是否正常,是否存在对蜘蛛隐藏的内容。

- 抓取头信息:了解蜘蛛的User-Agent、抓取时间等。

这个工具对于排查“为什么页面没收录”、“蜘蛛看到的内容和用户看到的是否一致”等问题极其有效。

2.2 “Robots”工具

Robots.txt是网站指导蜘蛛抓取行为的第一个指令文件。百度搜索资源平台提供了:

- 检测工具:校验robots.txt文件的语法是否正确,规则是否生效。

- 生成工具:引导用户快速生成标准的robots.txt文件。

合理配置robots.txt,可以避免蜘蛛抓取无意义的页面(如后台登录页、重复内容),节约网站的抓取配额。

2.3 “死链提交”与“网站改版”工具

当网站存在大量404死链时,会浪费蜘蛛的抓取资源,甚至影响站点评价。通过死链提交工具,可以主动告知百度,加速其清除失效索引。网站改版工具则能在大规模URL变更时,向百度提交新旧链接对应关系,保障权重平稳传递,避免流量断崖式下跌。

2.4 “Sitemap提交”工具

Sitemap(网站地图)是一个XML文件,列出了网站上所有重要页面的URL。主动向百度提交Sitemap,可以:

- 帮助蜘蛛更高效、更全面地发现网站内容,尤其是那些通过普通链接难以到达的深层页面。

- 提供页面的最后修改时间、更新频率等信息,辅助蜘蛛制定抓取计划。

关于如何高效生成和管理Sitemap,可以参考一些专业的技术资源,例如一个名为

的实用指南,其中详细介绍了多种主流CMS和自定义网站的Sitemap生成方案。三、 实战指南:优化蜘蛛抓取的策略

掌握了工具之后,更重要的是如何运用策略,引导百度蜘蛛更友好、更高效地抓取你的网站。

3.1 技术层面优化

- 确保网站可访问且稳定:服务器 downtime、过慢的响应速度(建议秒开)都会导致抓取失败或频率降低。

- 清晰的网站结构:扁平化或树状结构,确保从首页到任何重要内容页面最多在3-4次点击内到达。合理使用面包屑导航。

- 优化内部链接:通过文章内的相关推荐、导航栏、底部链接等方式,为重要页面建立丰富、相关的内链,为蜘蛛铺设爬行通道。

- 正确处理JS/动态内容:虽然百度蜘蛛对JavaScript的渲染能力在增强,但对于核心内容,仍建议使用服务端渲染(SSR)或预渲染(Prerender)确保其能被直接抓取。

- 移动适配:严格遵循百度推荐的移动适配方案(响应式设计、独立移动站加对应关系标注),确保移动蜘蛛能获取到优质体验的内容。

3.2 内容与策略优化

- 创造高质量原创内容:这是吸引蜘蛛频繁光顾的根本。定期更新、对用户有价值的页面,自然会被赋予更高的抓取优先级。

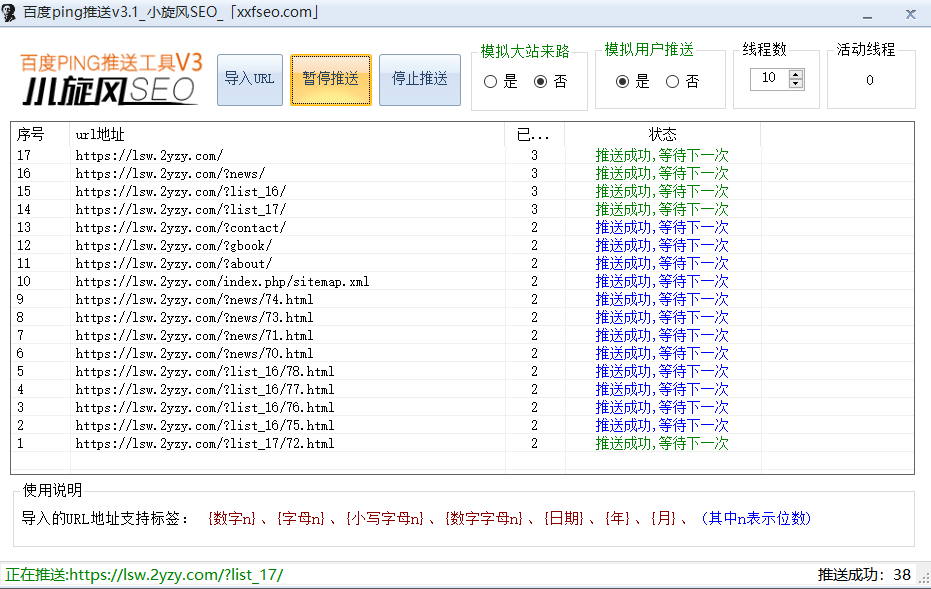

- 善用“链接提交”API:对于新发布或重要更新的内容,可以通过百度提供的API接口主动、实时推送URL,实现最快的抓取和收录。

- 分析日志文件:定期查看服务器日志中百度蜘蛛(通过User-Agent识别)的访问记录。分析它经常抓取哪些页面、遇到哪些错误(如404、500)、抓取频率如何。这是最真实的一手数据,能揭示工具模拟测试之外的问题。

- 合理利用“抓取频次”设置:在搜索资源平台中,网站可建议百度蜘蛛每日的抓取总频次上限。对于新站或服务器资源有限的小站,可以适当调低以避免服务器压力;对于内容更新快、服务器强劲的站点,可以申请提高。

四、 常见问题与误区

- 误区一:屏蔽蜘蛛就能防止抄袭:完全错误。robots.txt只能作为君子协定,恶意爬虫不会遵守。防抄袭应依赖技术手段(如加密、水印)和法律武器。

- 误区二:抓取就等于收录:抓取是收录的必要非充分条件。蜘蛛抓取后,还会对内容进行质量、相关性、合规性评估,只有通过的页面才会进入索引库。

- 常见问题:网站更新了,但百度快照迟迟不更新:首先使用“抓取诊断”工具确认蜘蛛能抓取到新内容;其次,通过API或Sitemap主动提交该URL;最后,检查该页面是否有足够的内外链引导蜘蛛再次爬取。

- 常见问题:蜘蛛抓取异常返回403/503:检查服务器安全设置(如防火墙、IP黑名单)是否误封了百度的蜘蛛IP段;检查服务器当前负载是否过高。

结论:与蜘蛛为友,共赢搜索生态

百度蜘蛛抓取工具及相关策略,并非高深莫测的黑盒技术,而是一套基于公开协议和逻辑的、可被理解和优化的系统工程。其核心思想是“降低蜘蛛的理解成本,提升其抓取效率”。作为网站方,我们应当化被动为主动,不再将蜘蛛视为不可控的访客,而是将其当作最重要的特殊用户来对待。

通过熟练运用百度搜索资源平台的各项工具,结合扎实的网站技术基础与持续的内容建设,我们能够为百度蜘蛛铺平道路,确保网站的核心价值被快速、准确地发现和传递。最终,这不仅提升了网站在搜索引擎中的表现,更本质的是优化了网站自身的结构、性能和内容,为所有用户带来了更好的访问体验,实现了搜索引擎、网站与用户的三方共赢。在数字时代的竞争中,掌握与搜索引擎高效沟通的能力,无疑是获取可持续流量的基石。

暂无评论内容